Quand le volume trompe : revue du scénario de faisabilité et de répartition du poids

On a tous déjà vu ça. Un taux de remplissage à 89 % sur le moniteur. Des palettes parfaitement emboîtées dans un cube 3D. Puis le quai bloque. Le transpalette refuse de pivoter. La rampe grince. L’algorithme a gagné sur le papier. La réalité physique reprend ses droits immédiatement. Le problème ne vient pas du solveur. Il vient de ce qu’on lui a permis de voir.

Le leurre du taux de remplissage

Pourquoi l’optimisation volumétrique rate-t-elle si souvent sa cible sur le terrain ? Parce qu’on traite les dimensions internes comme des variables administratives. Erreur fréquente. Un conteneur standard ne se réduit pas à un parallélépipède euclidien. C’est un environnement à contraintes cinématiques. Les cotes d’ouverture dictent le débattement. La rigidité des longerons impose une répartition linéique de charge. Ignorer le centre de masse, c’est inviter la torsion axiale.

L’approche classique repose sur des templates génériques et un contrôle a posteriori. Ça multiplie les arrêts en quai. Ça génère des rapports d’incident. Ça coûte du temps. L’approche fiable impose la saisie explicite des dimensions réelles d’accès. Elle verrouille les limites de poids avant le premier calcul. Elle injecte des marges de sécurité nominales. Sans ces bornes, le moteur produit des plans mathématiquement cohérents. Mais physiquement inapplicables.

Vérification croisée & limites du parser

Ce qu’il faut vérifier manuellement, c’est précisément ce que les modèles génériques omettent. La validation croisée des données brutes n’est pas une étape cosmétique. C’est un pare-feu. Les spécifications constructeur décrivent un état théorique. Neuf. Idéal. Le conteneur, lui, subit la fatigue métallique. Les seuils de porte s’affaissent. Les panneaux ondulés se déforment sous l’impact des fourches.

L’outil automatise l’extraction. Il aligne les champs. Mais il ne mesure pas l’usure réelle. Si on lui donne 233 cm d’ouverture, il calculera un passage libre pour 233 cm. La marge de manœuvre effective, elle, appartient à l’opérateur. C’est pour ça qu’on réduit délibérément la cote de 2 à 4 cm lors de la saisie. C’est trivial. On l’oublie trop souvent. La technologie structure le jugement. Elle ne le supplée pas.

Verrouillage des bornes : workflow sous le capot

Pour solidifier le périmètre de calcul, on ne bricole pas. On ingère, on valide, on persiste. Voici comment la chaîne s’articule quand on refuse de laisser le hasard dicter les contraintes.

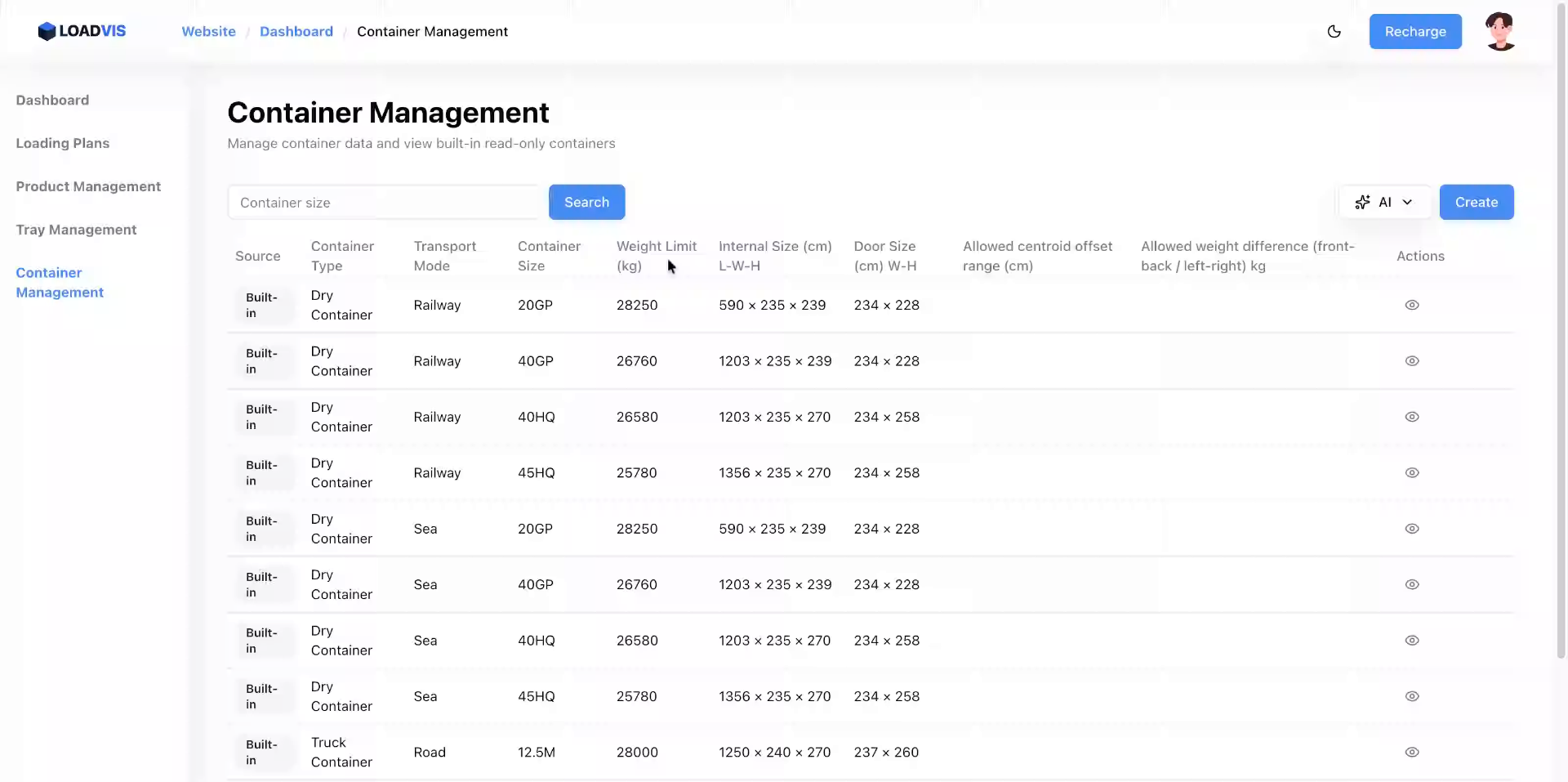

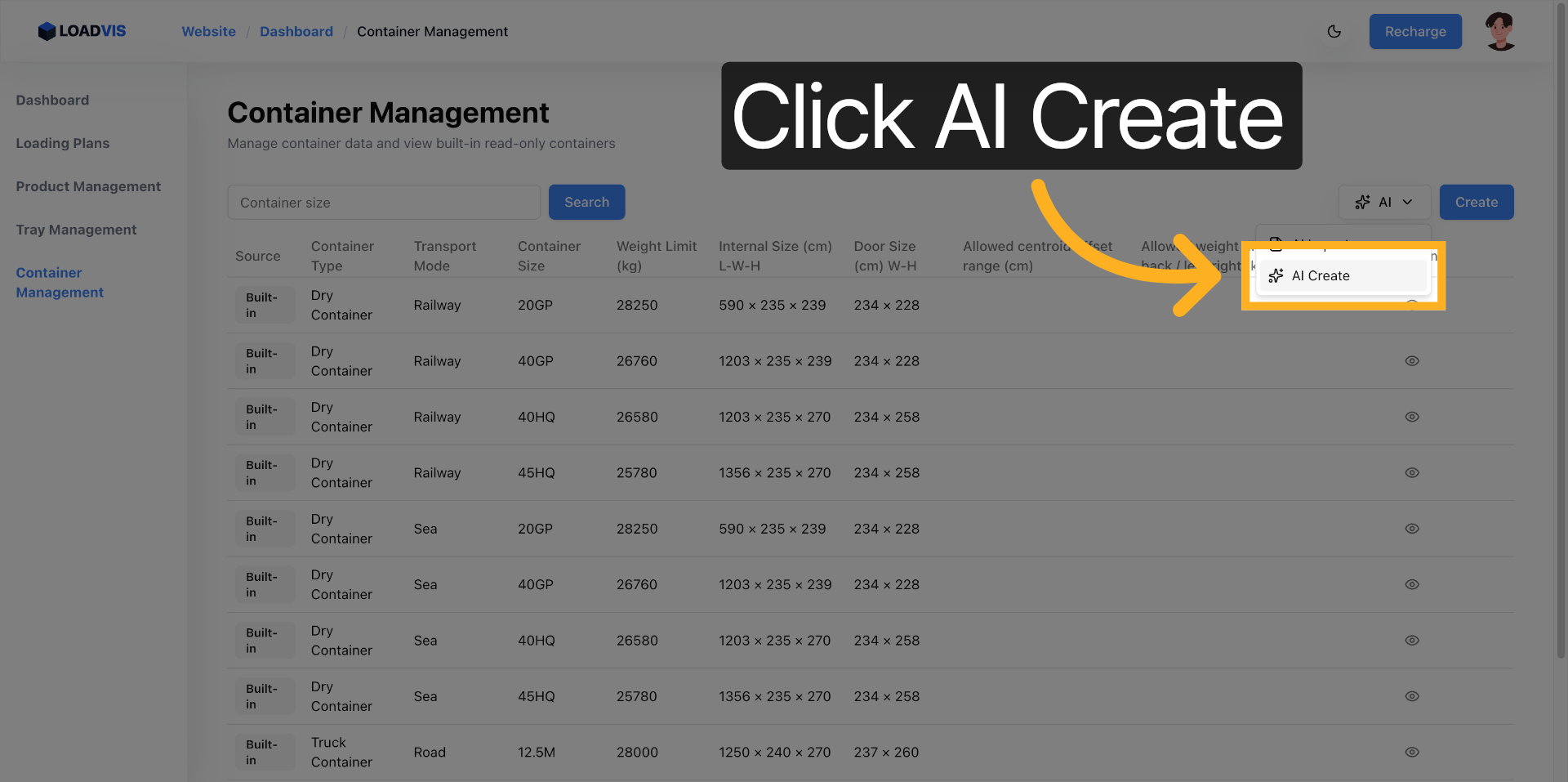

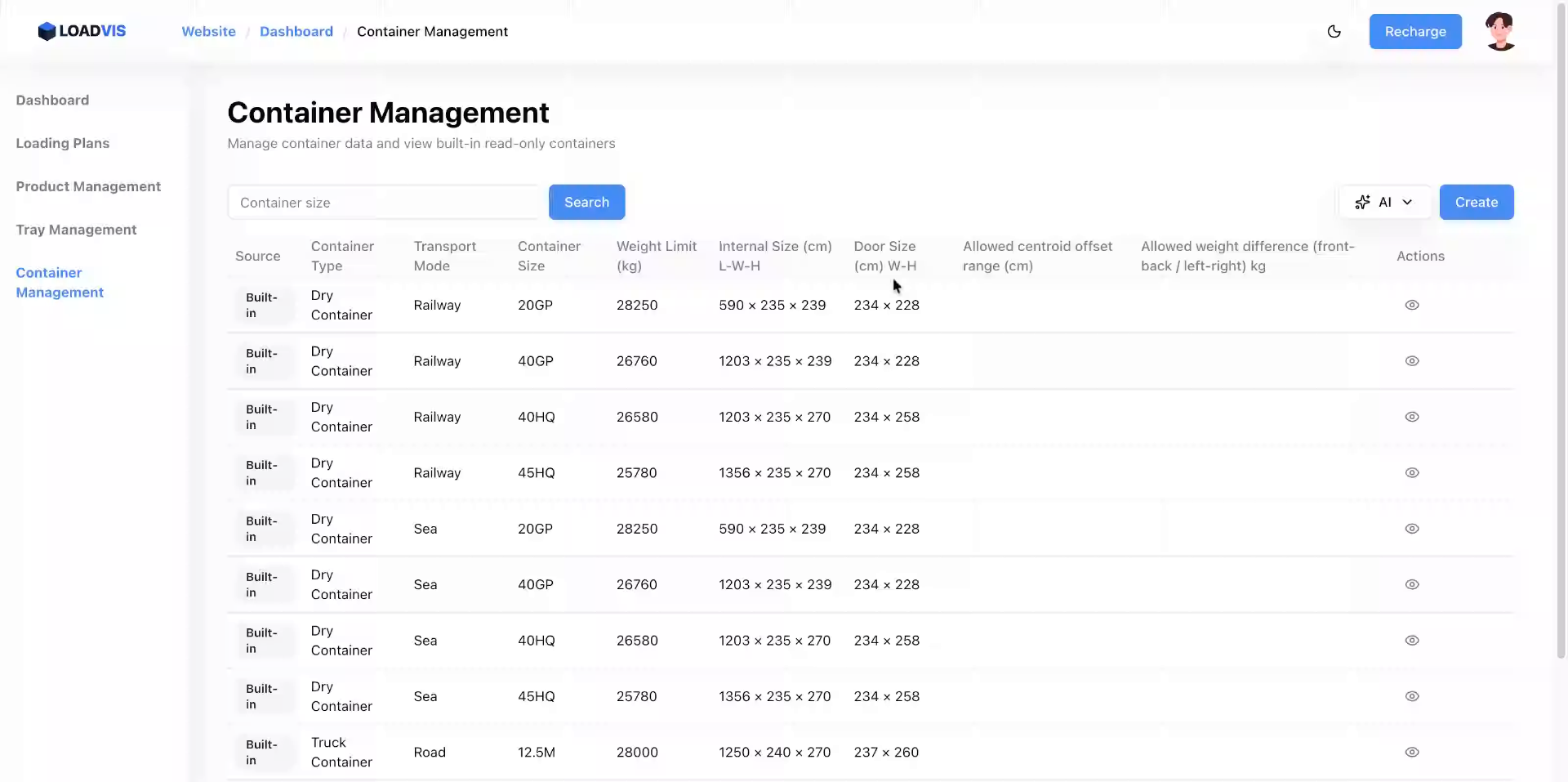

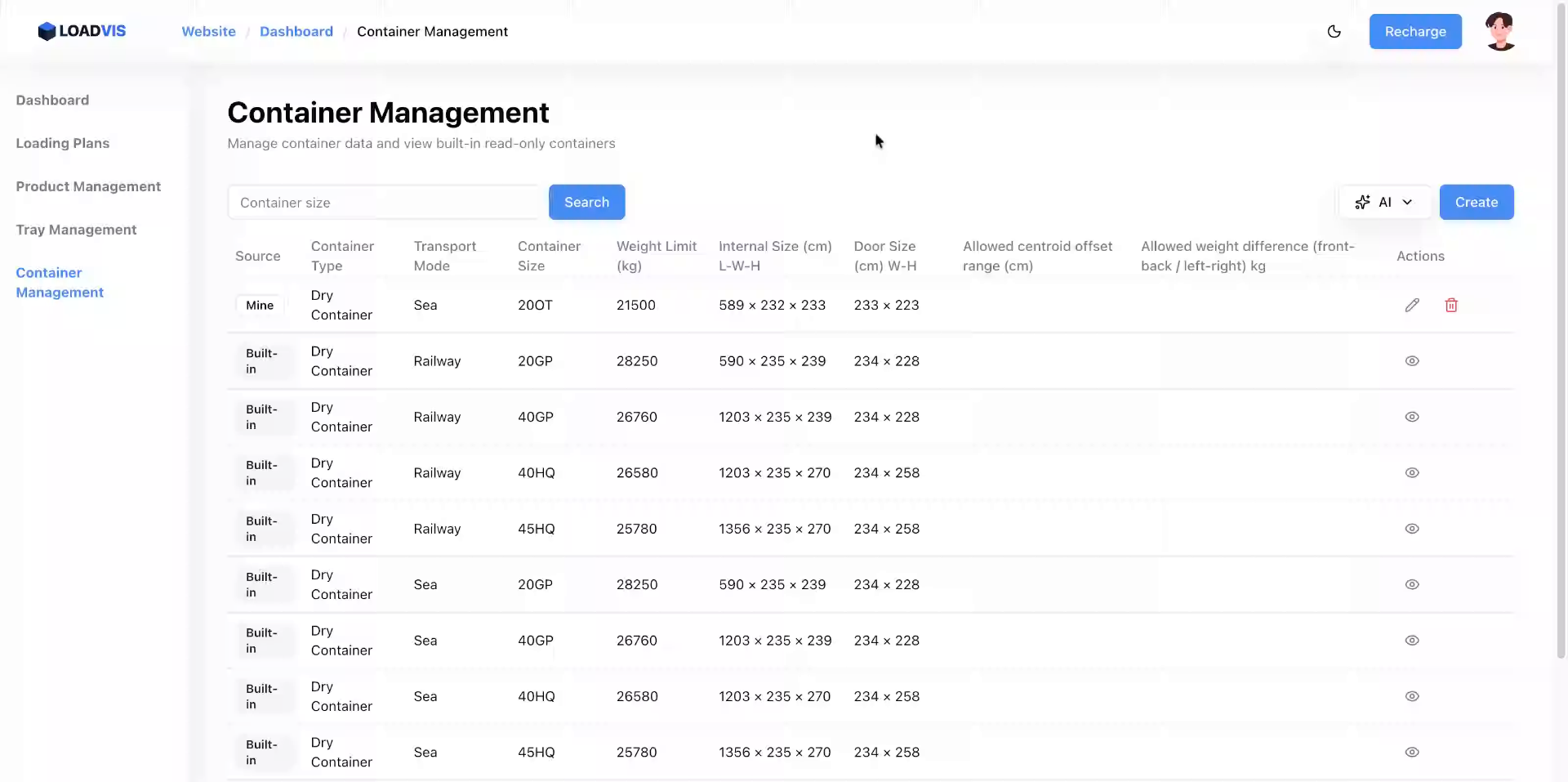

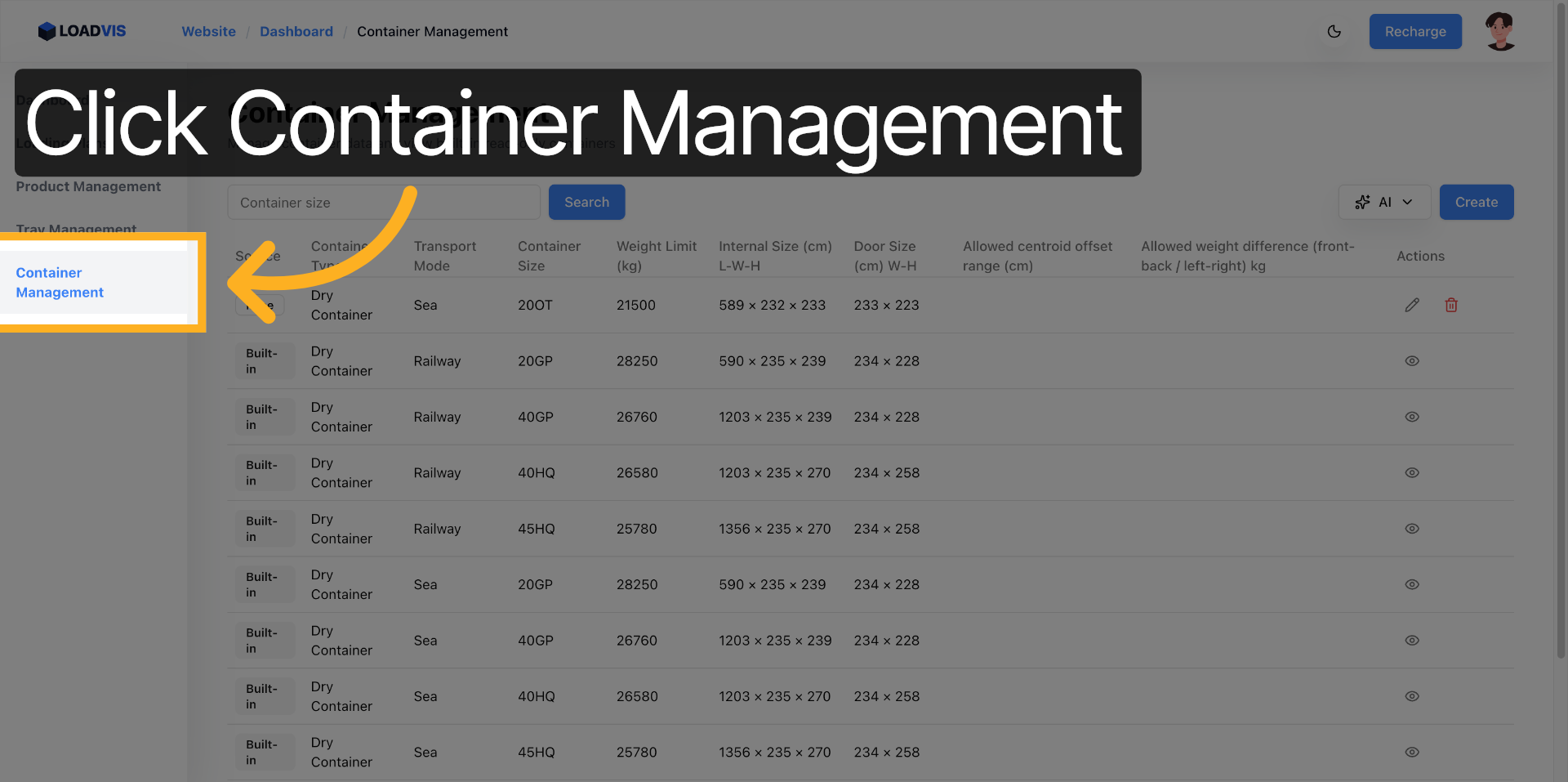

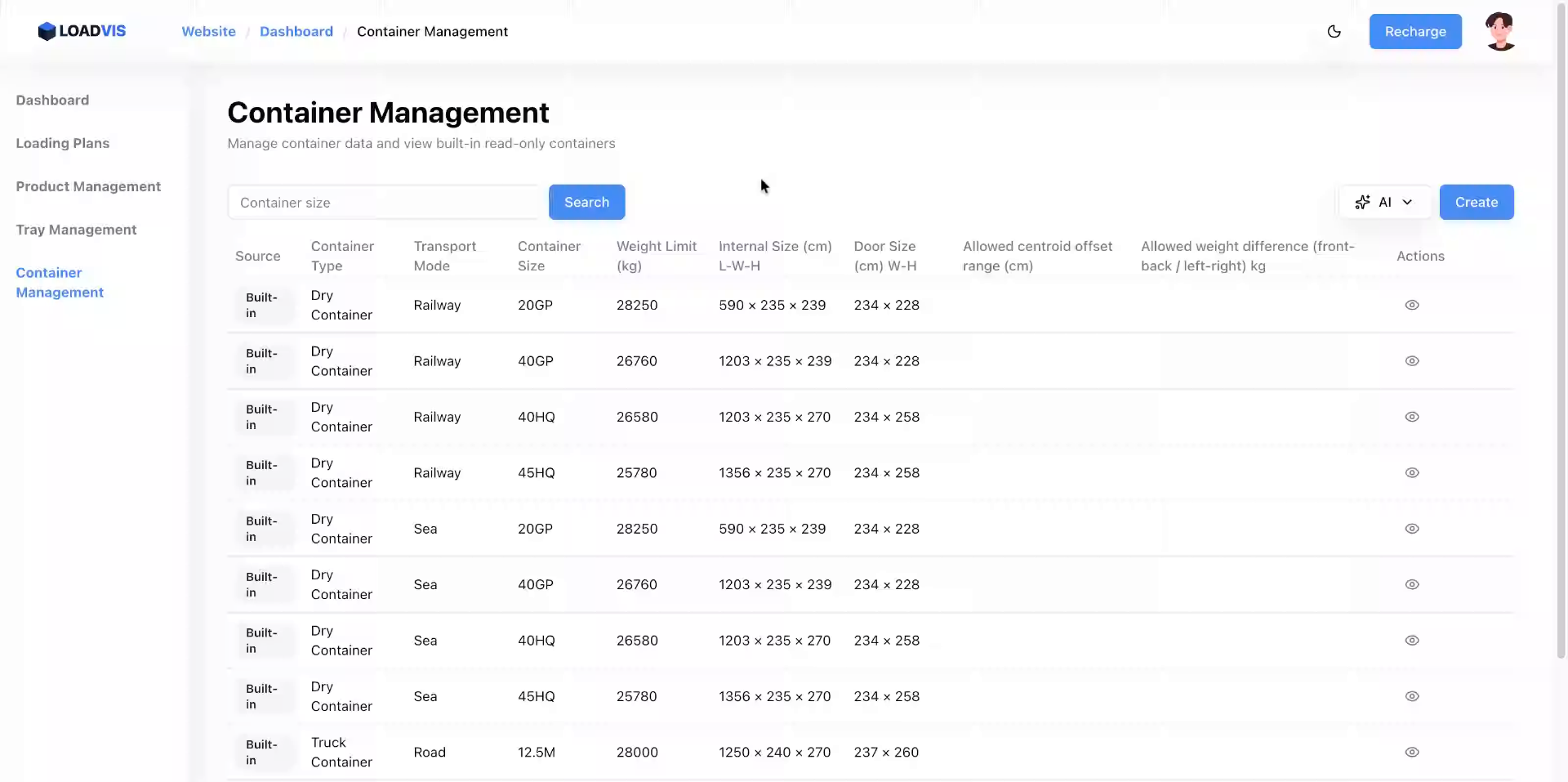

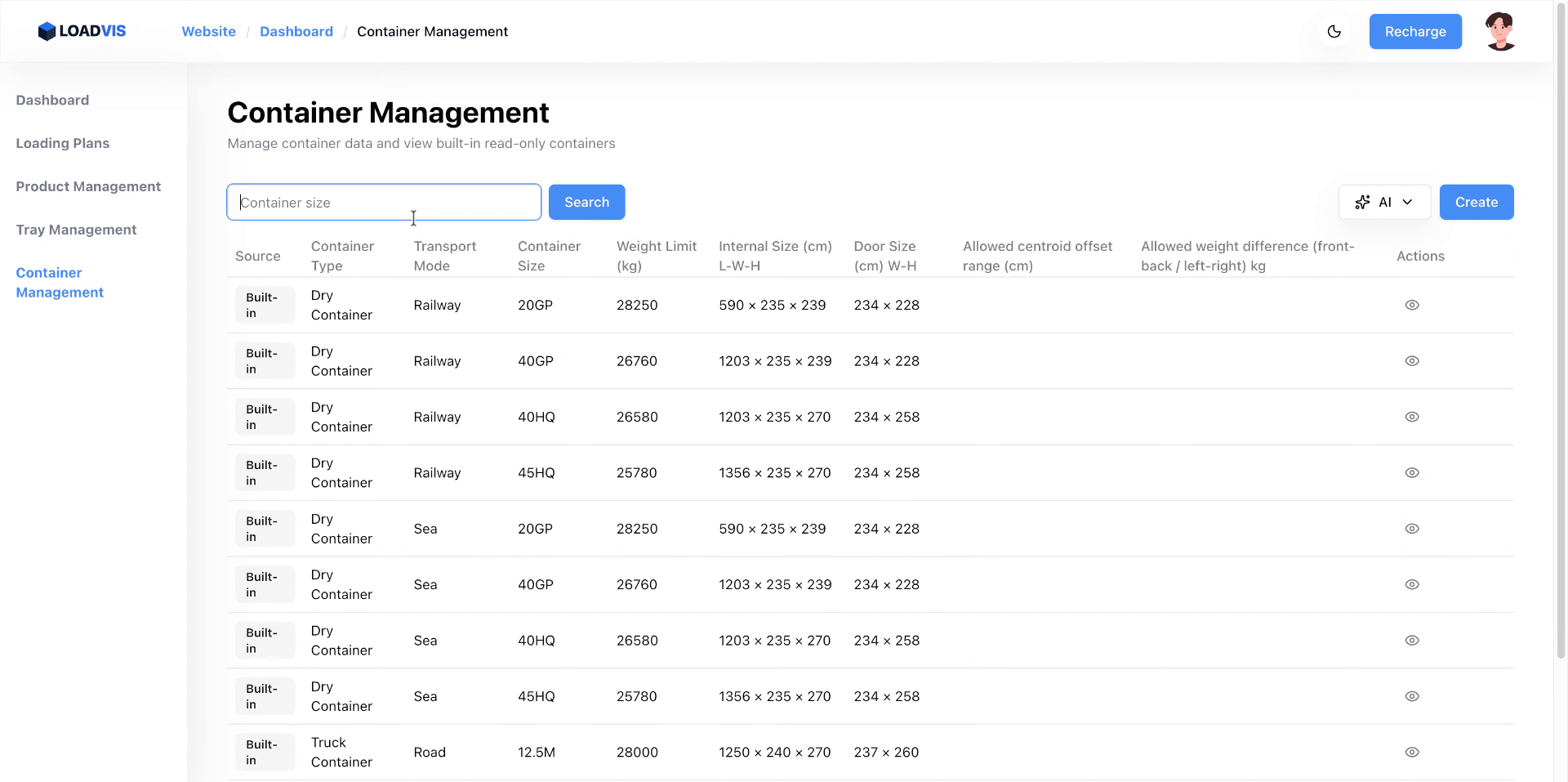

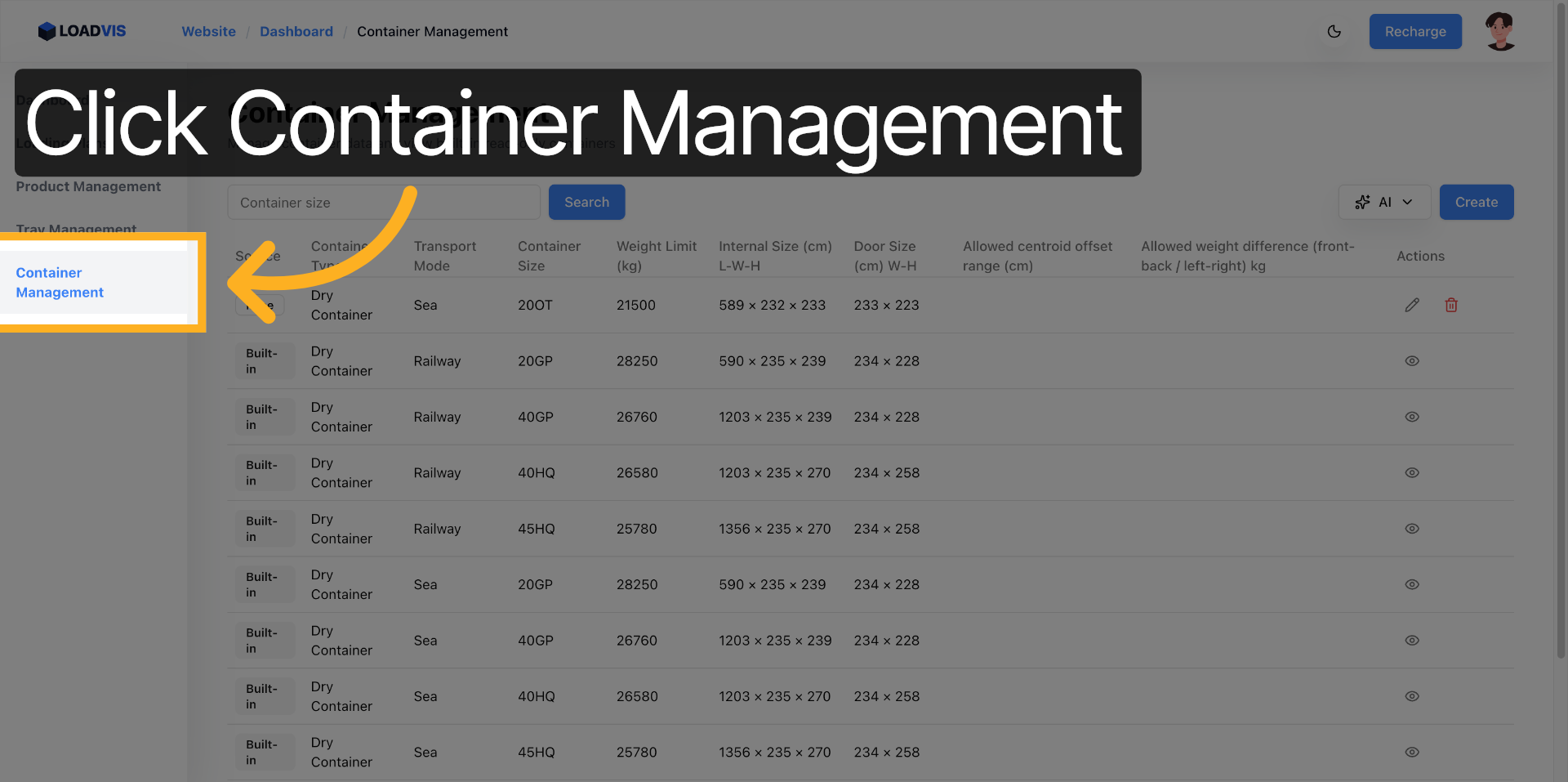

On commence par basculer dans l’espace de gestion des conteneurs. Pas de configuration implicite. Tout part d’une base propre.

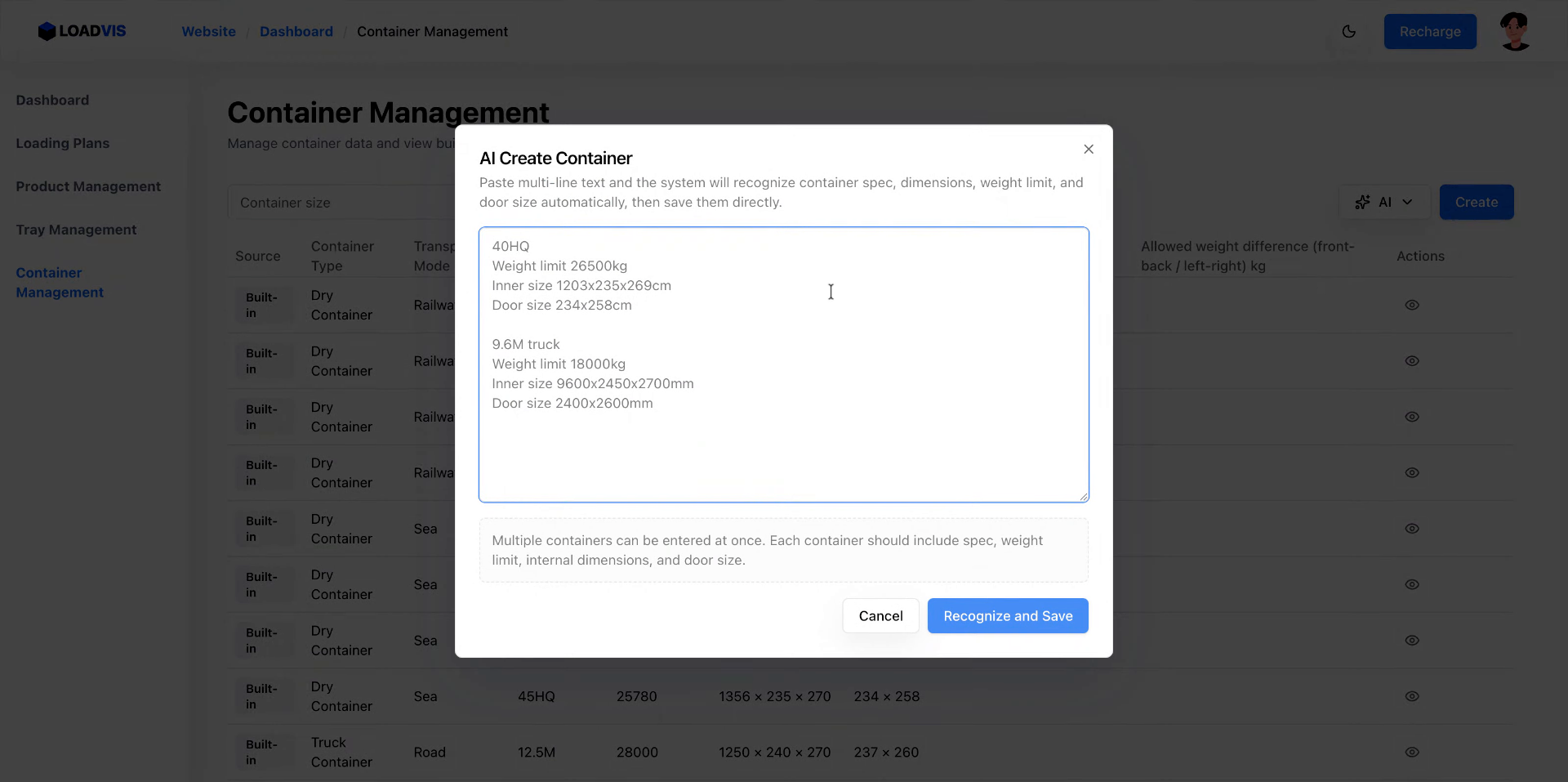

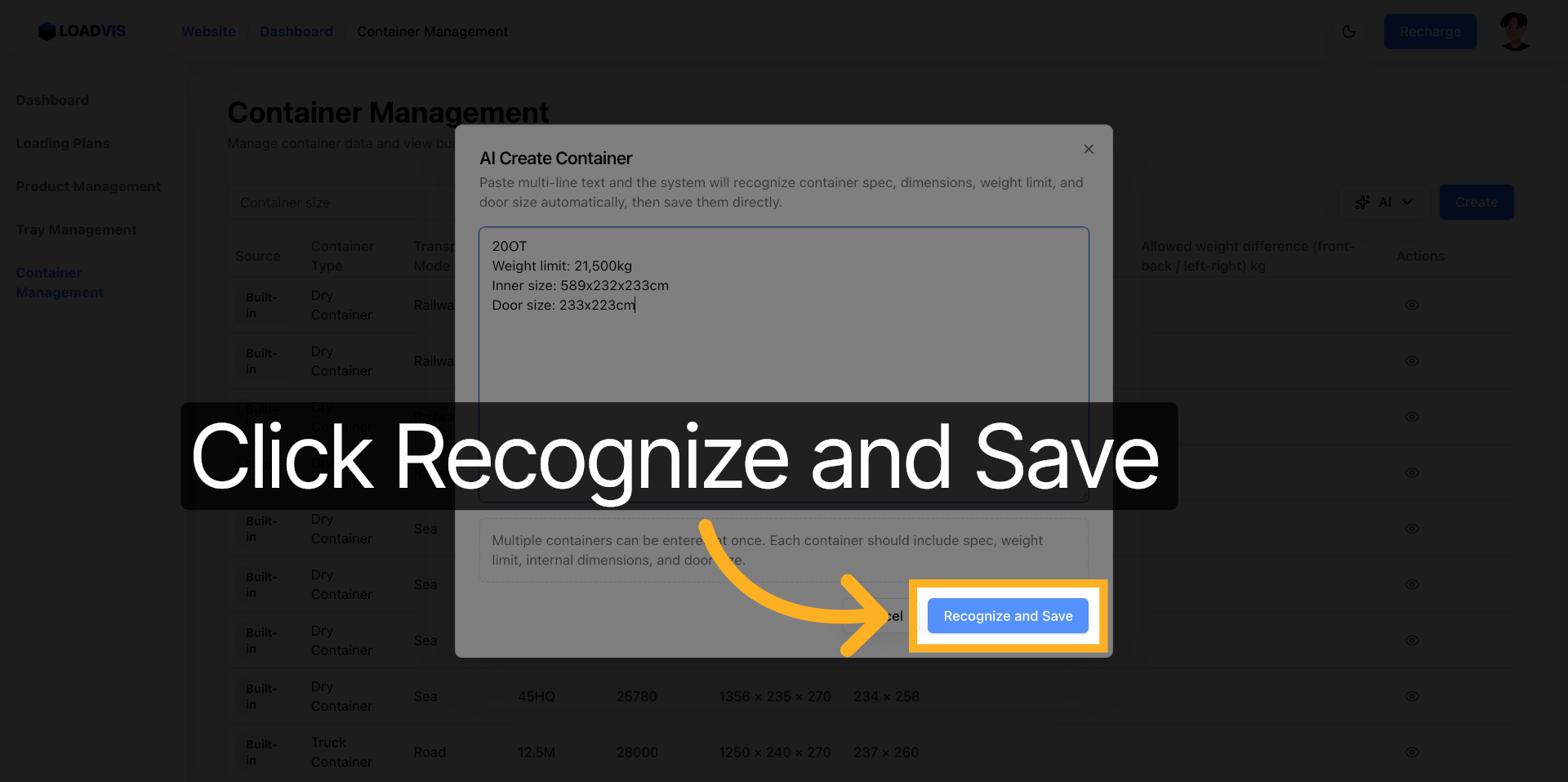

L’extraction intelligente parse le flux brut. On lui donne une chaîne type 20OT Poids max : 21 500 kg Dimensions intérieures : 589×232×233 cm Ouverture de porte : 233×223 cm. Le moteur segmente. Il mappe les tokens. Il prépare la structure.

Mais l’automatisation s’arrête à la syntaxe. On doit valider la sémantique. On clique. On vérifie l’alignement des unités. On confirme la persistance. La liste se rafraîchit. L’entrée existe.

Mais l’automatisation s’arrête à la syntaxe. On doit valider la sémantique. On clique. On vérifie l’alignement des unités. On confirme la persistance. La liste se rafraîchit. L’entrée existe.

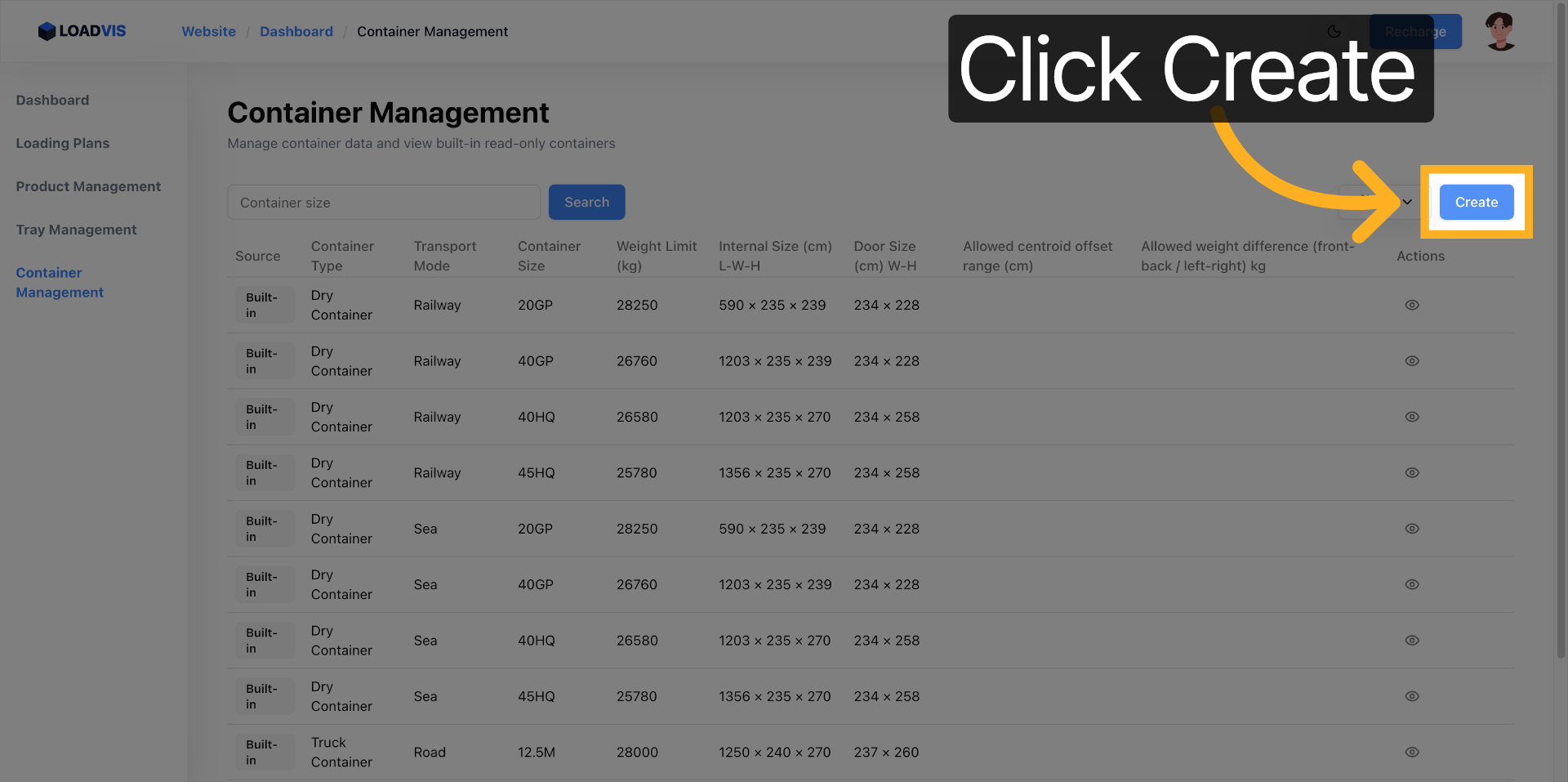

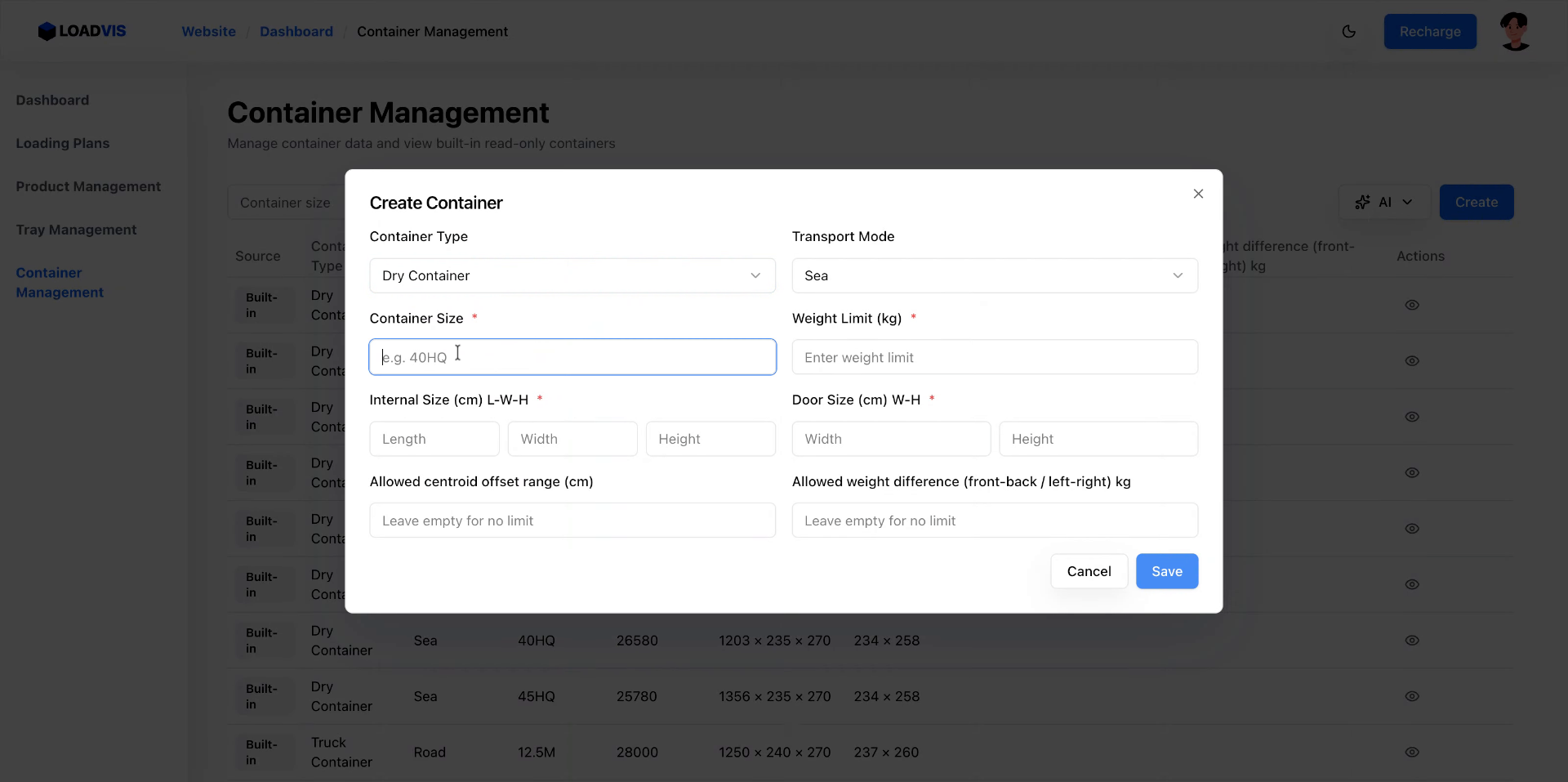

Si le conteneur sort d’un chantier spécifique, on part de zéro. La création manuelle suit la même logique de verrouillage. Code unique. Charge nominale. Long, larg, haut internes. Et surtout, la cote d’ouverture réelle. C’est le goulot.

On saisit l’identifiant

On saisit l’identifiant 20OT.

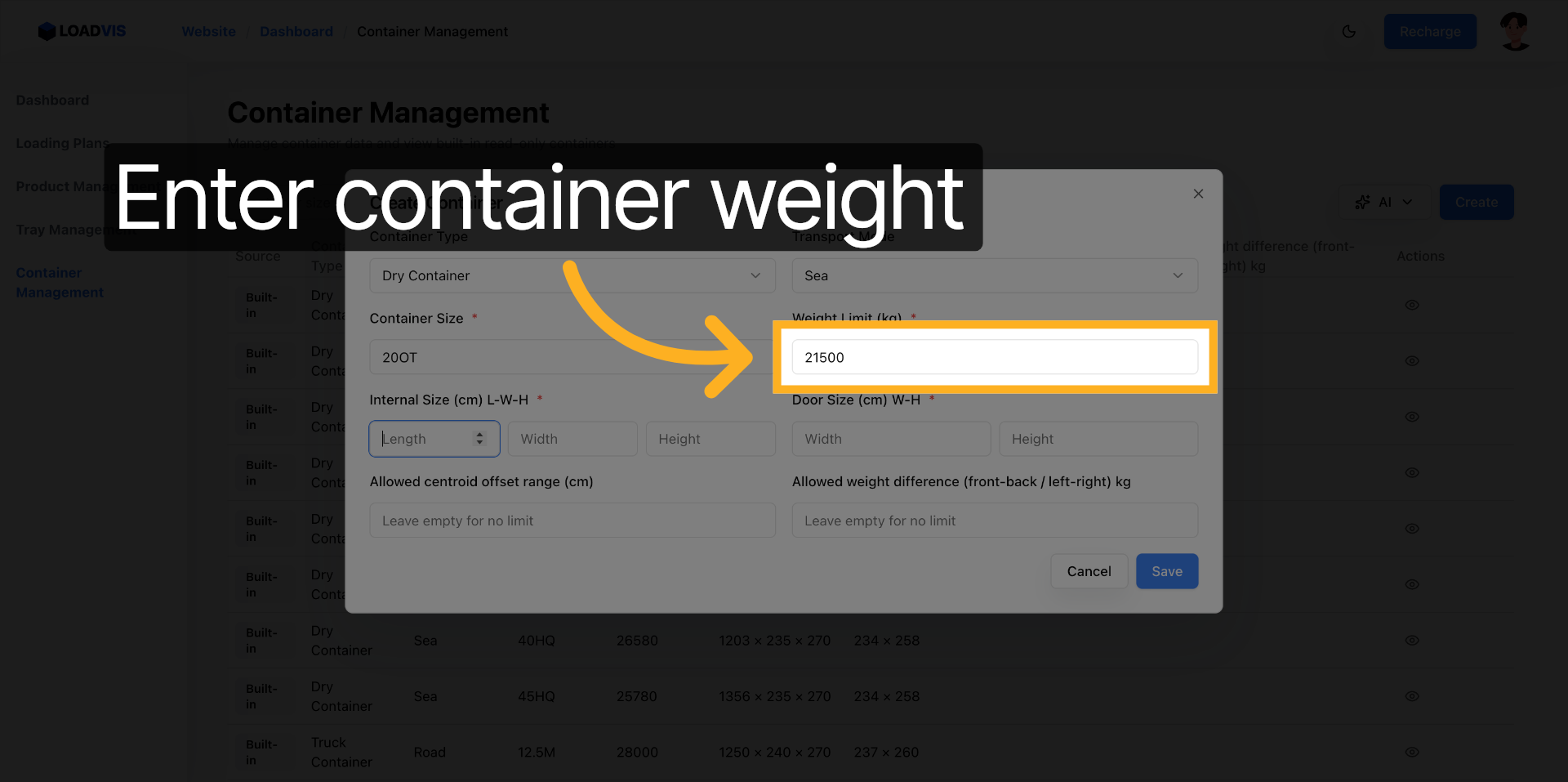

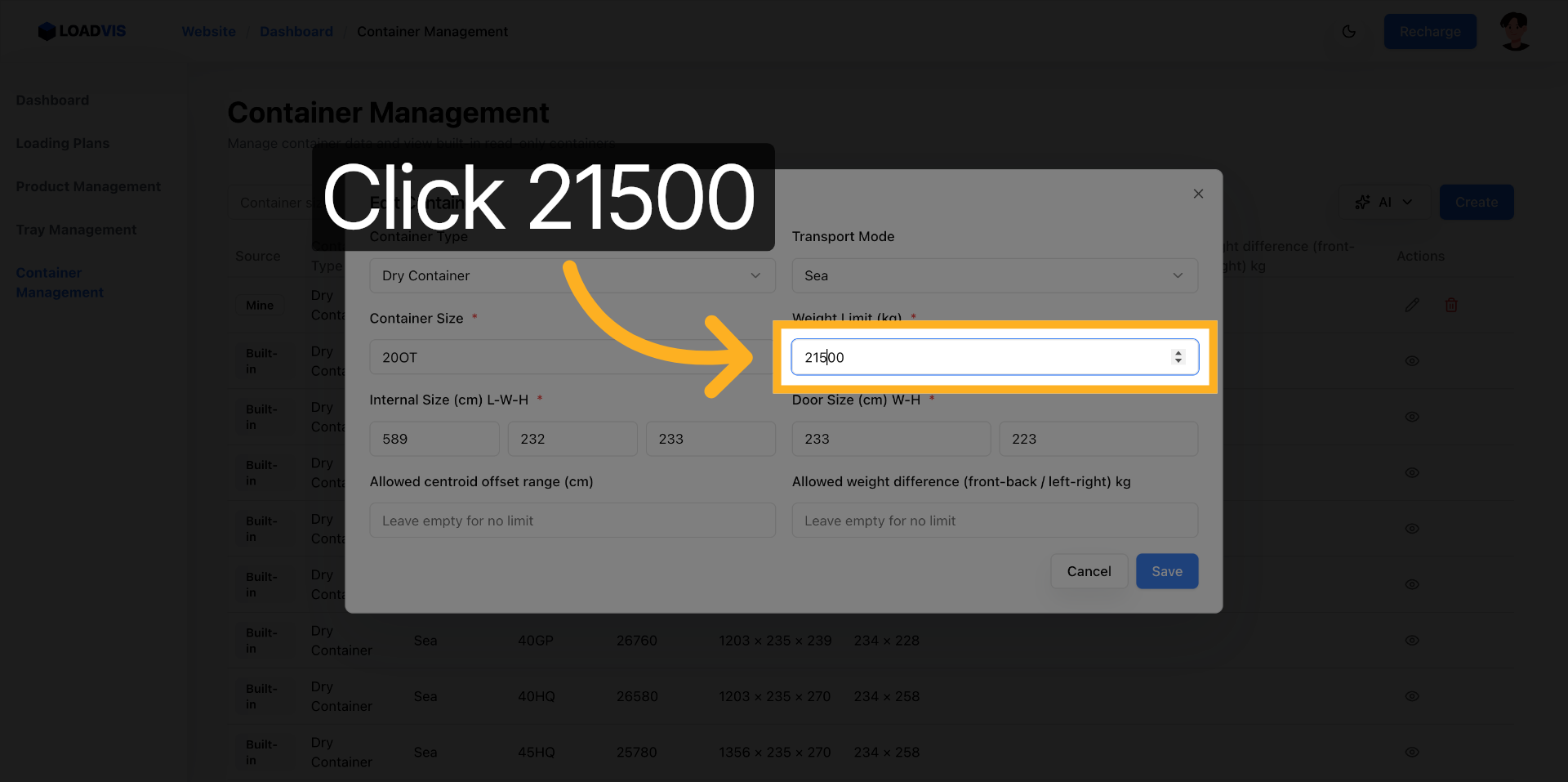

On fixe la limite structurelle :

On fixe la limite structurelle : 21500.

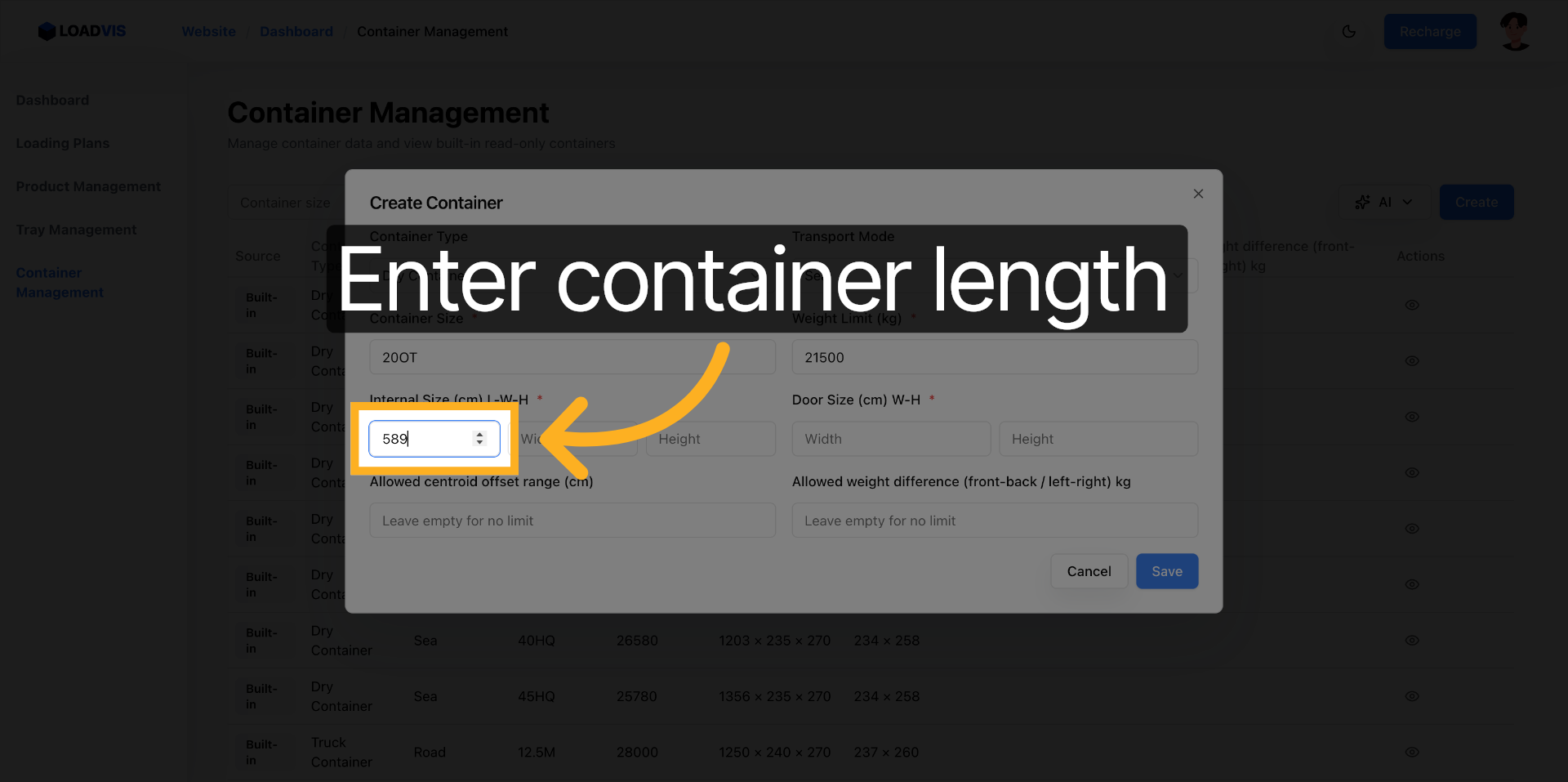

On injecte la géométrie interne.

On injecte la géométrie interne. 589 en longueur.

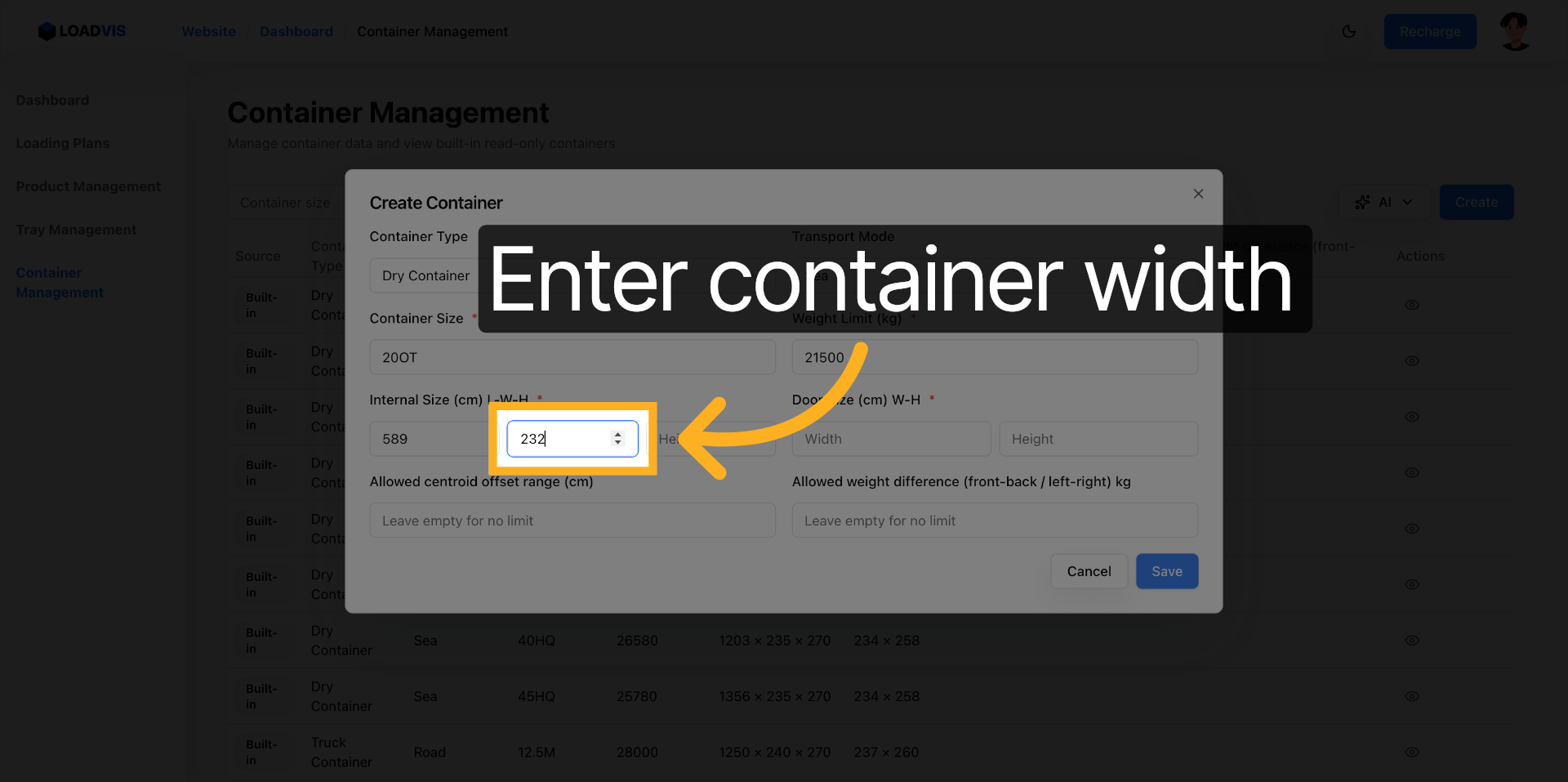

232 en largeur.

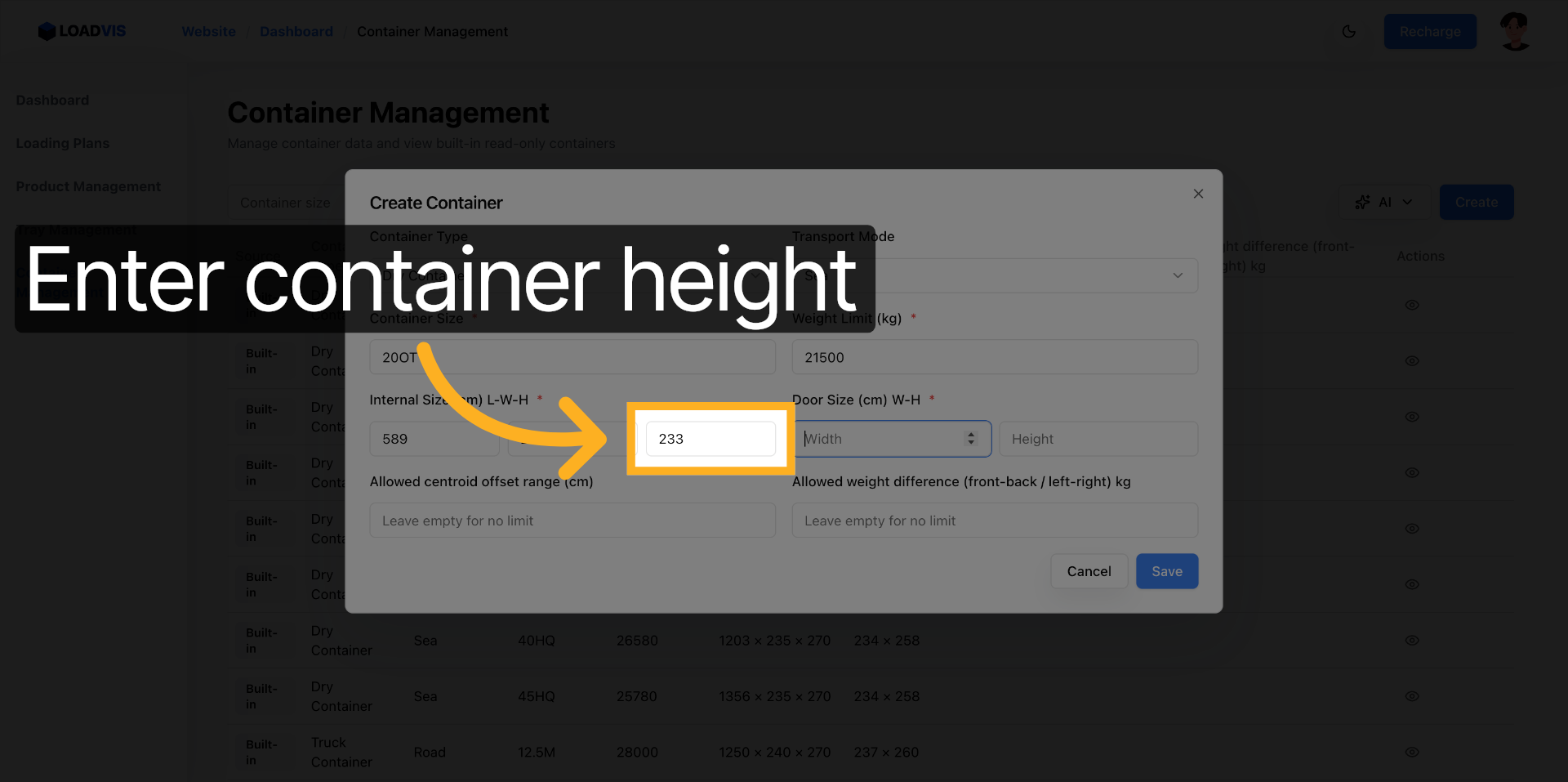

233 en hauteur.

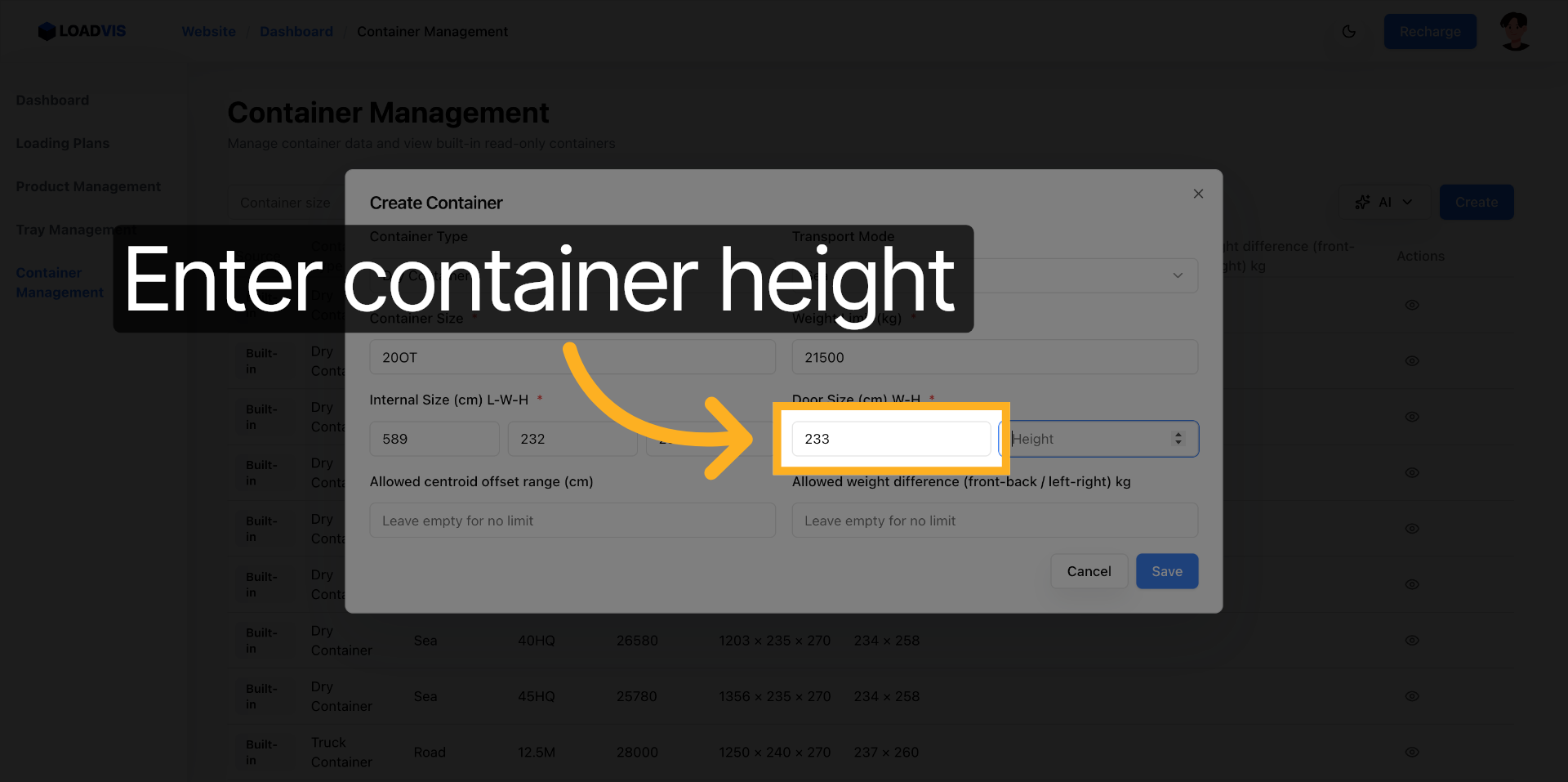

Et on ne néglige jamais l’accessibilité physique. L’ouverture de porte verrouille le plan de chargement. Sans elle, le calcul flotte.

Et on ne néglige jamais l’accessibilité physique. L’ouverture de porte verrouille le plan de chargement. Sans elle, le calcul flotte.

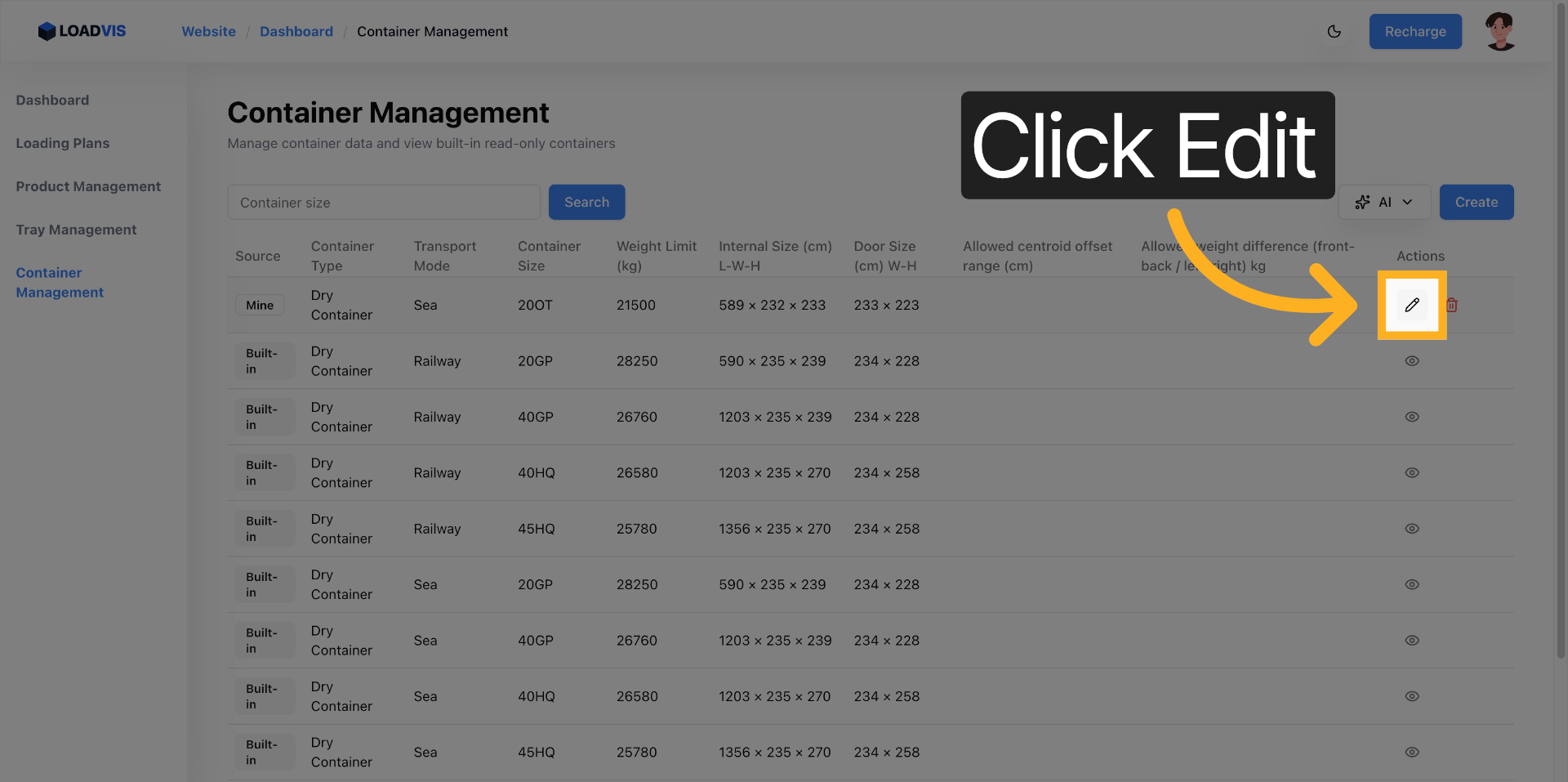

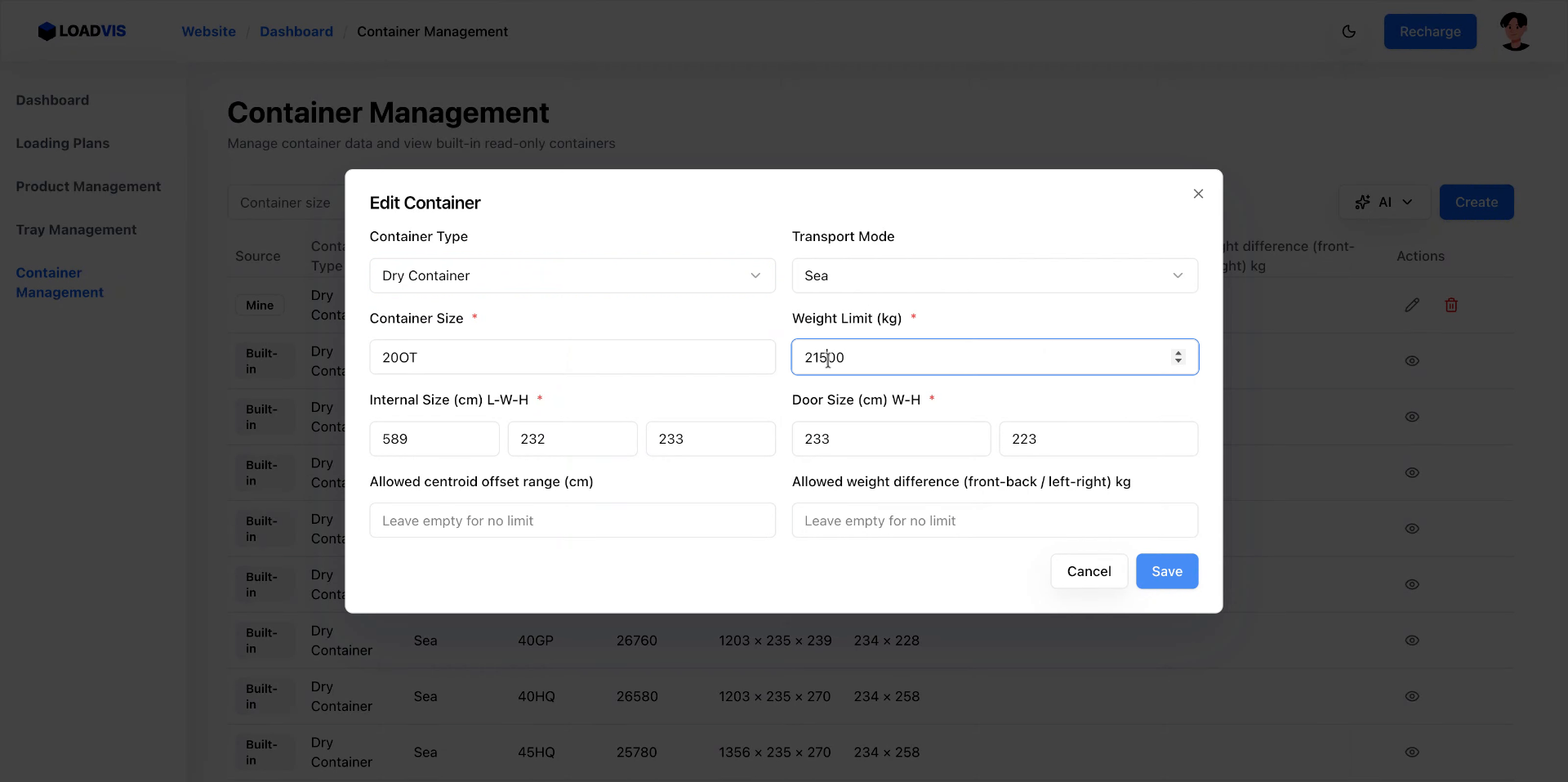

La maintenance des données suit ce même impératif de rigueur. Un conteneur révisé ? Ses cotes changent. On édite. On abat les anciennes valeurs. On inscrit les nouvelles. La cohérence du solveur dépend de cette fraîcheur.

On bascule en mode écriture.

On bascule en mode écriture.

On cible la charge.

On cible la charge. 21500.

On sélectionne le champ.

On sélectionne le champ.

On injecte

On injecte 21000. Marge de sécurité active.

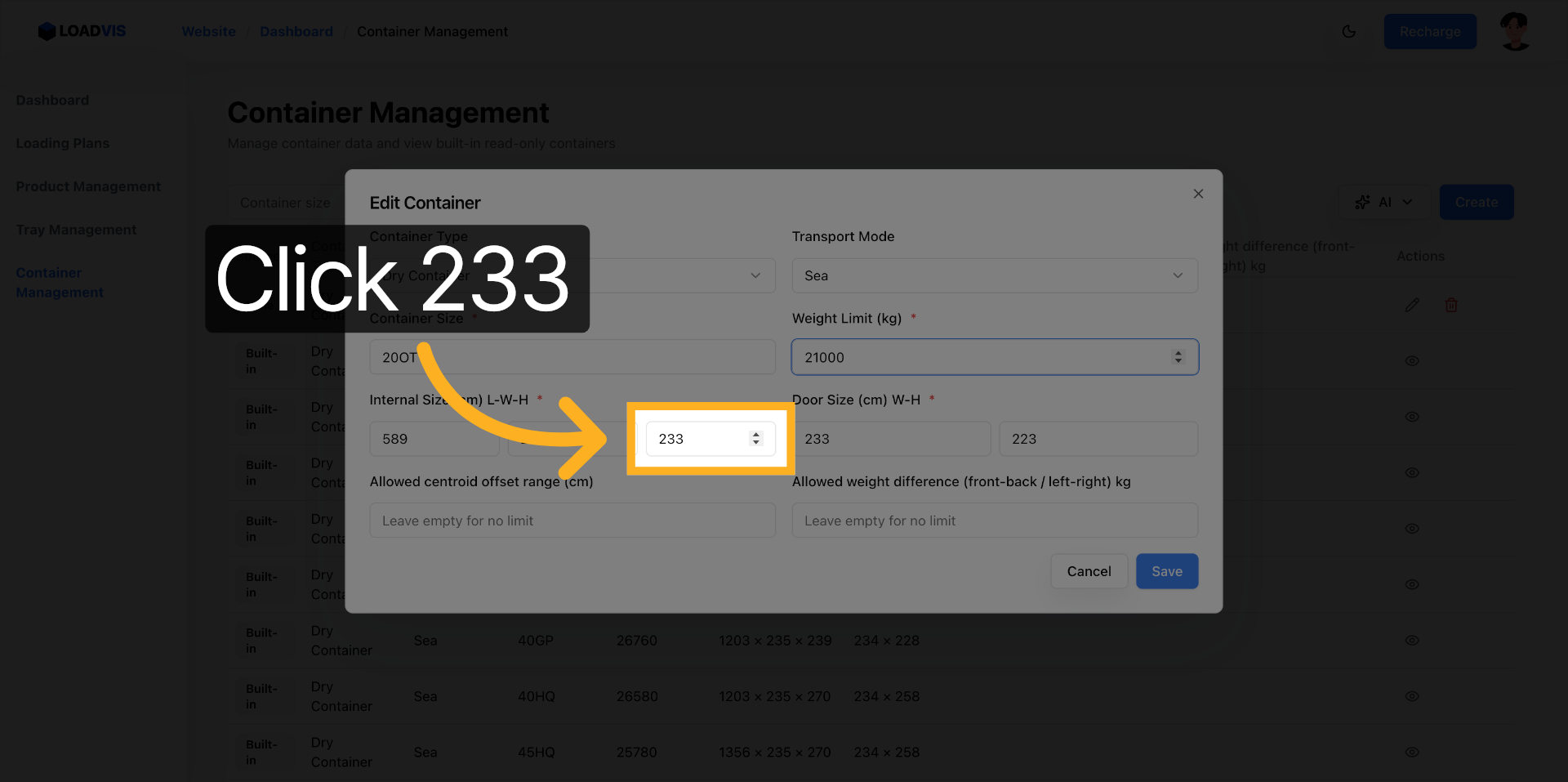

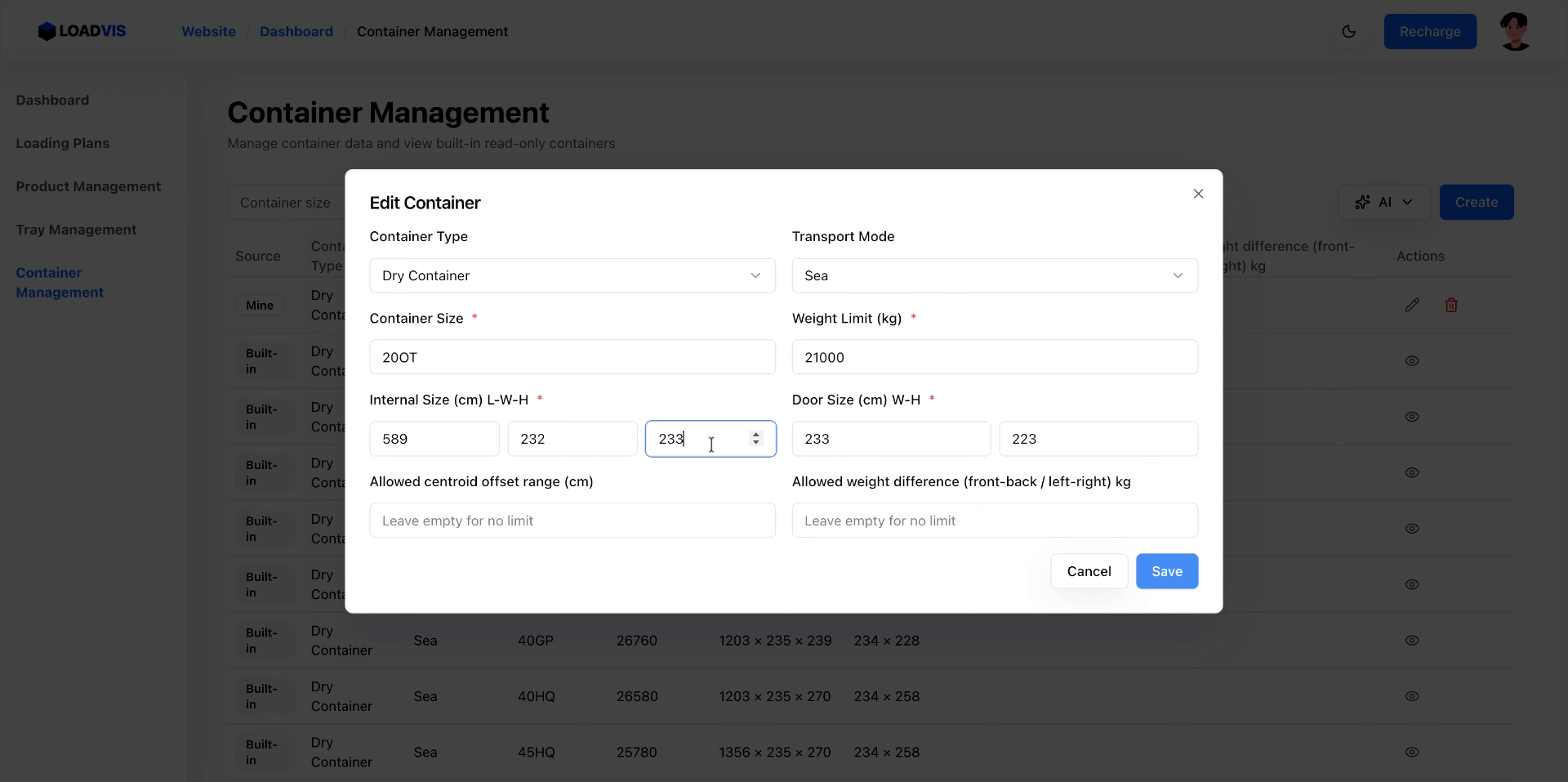

On traite la hauteur de porte.

On traite la hauteur de porte. 233.

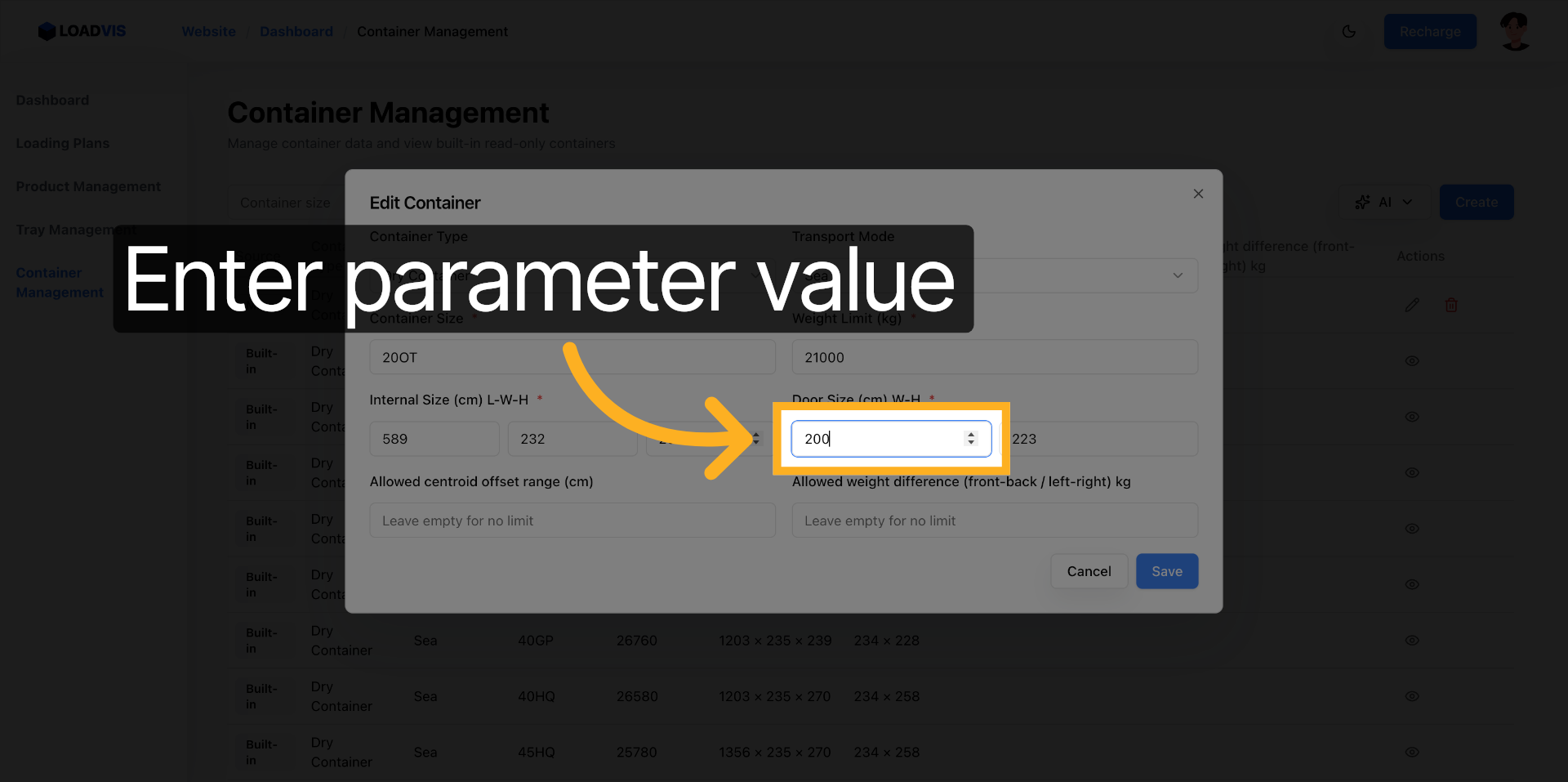

On passe à

On passe à 200. Charnières fatiguées. Sol déformé. On compense.

On ajuste la largeur à

On ajuste la largeur à 200.

On persiste. Le moteur recalculera avec ces nouvelles bornes.

On persiste. Le moteur recalculera avec ces nouvelles bornes.

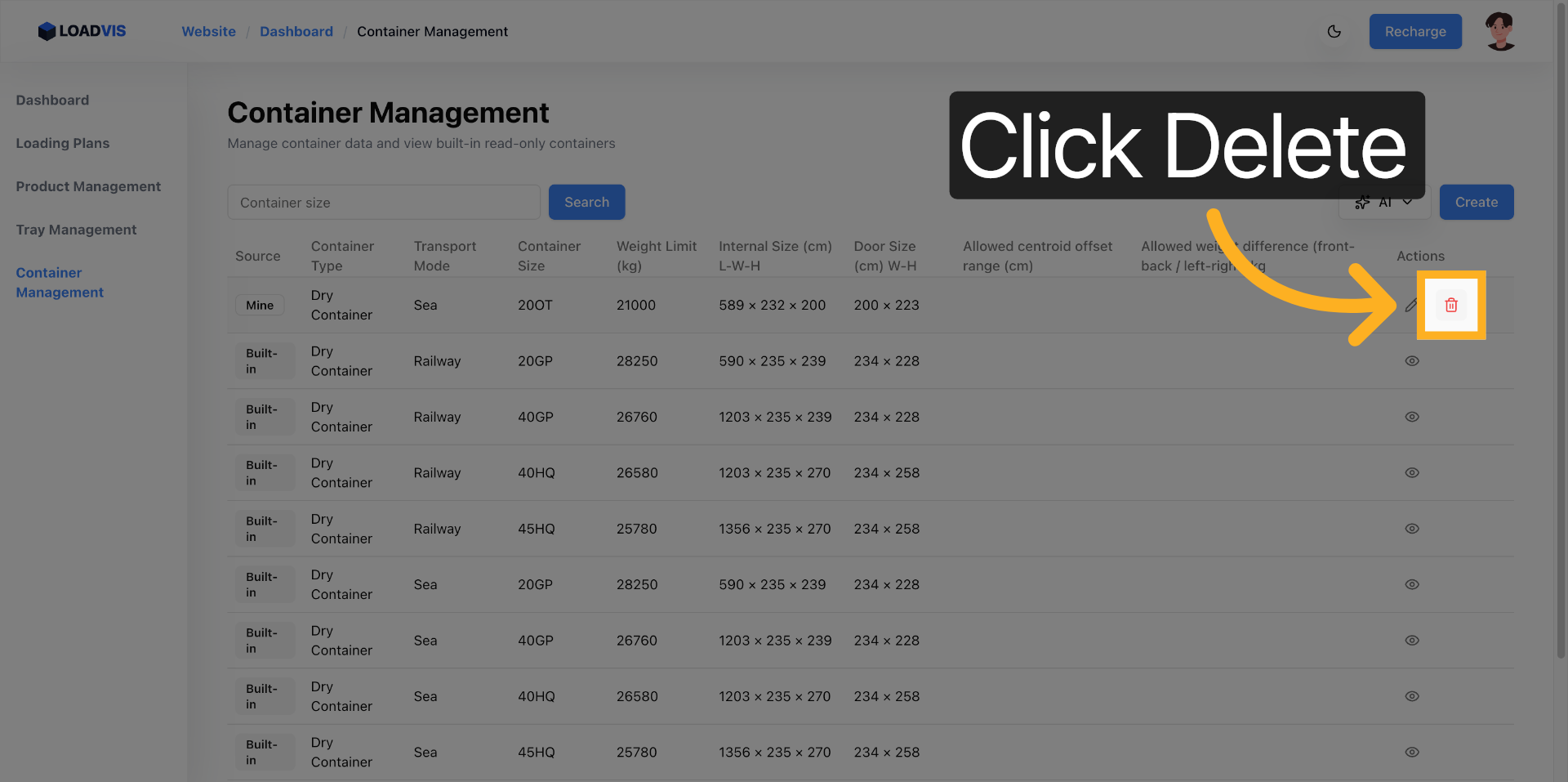

Pour le reste ? Nettoyage. Archivage. Une base polluée produit des résultats biaisés. On interroge. On filtre par taille. On supprime l’obsolescence.

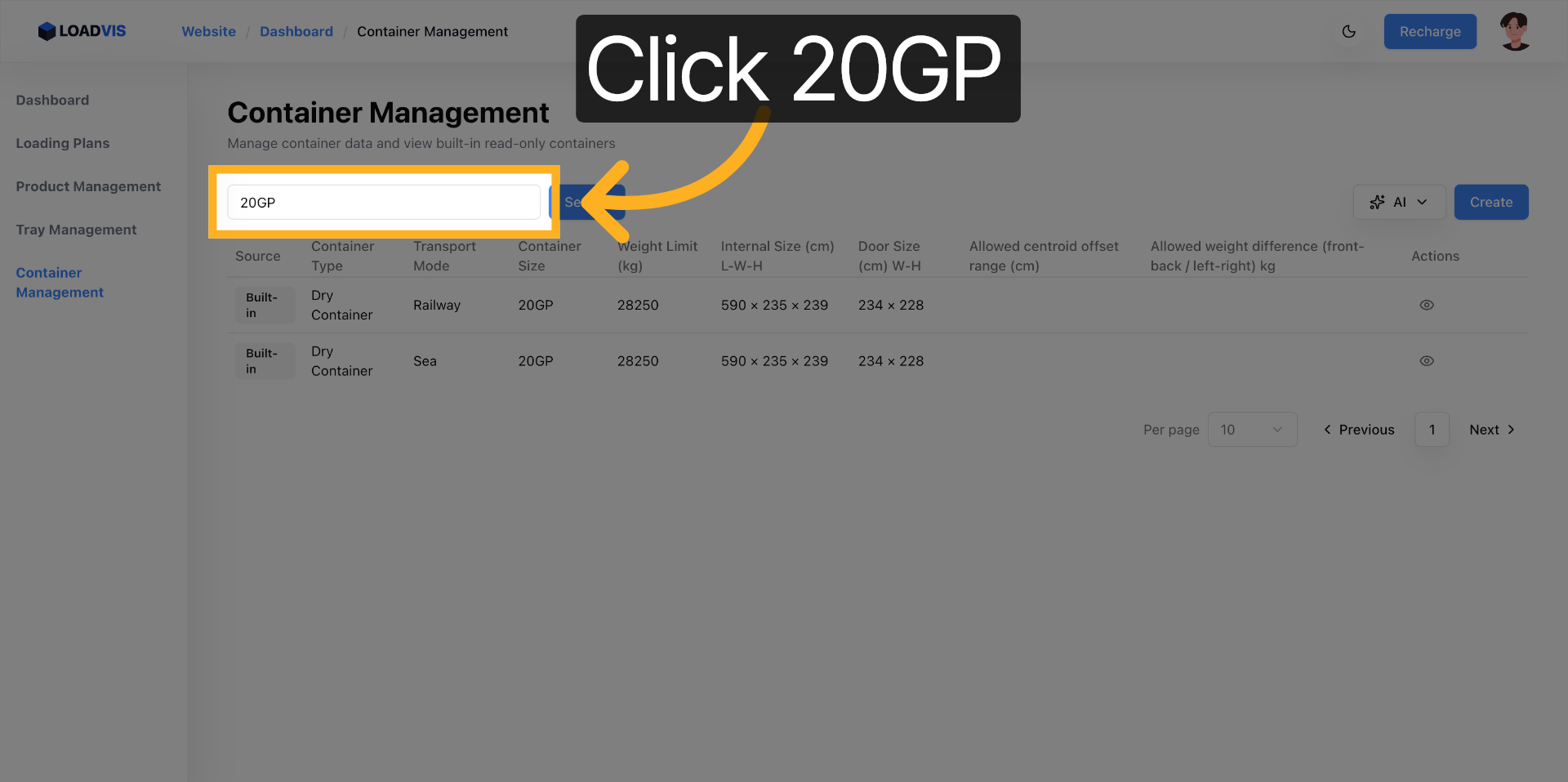

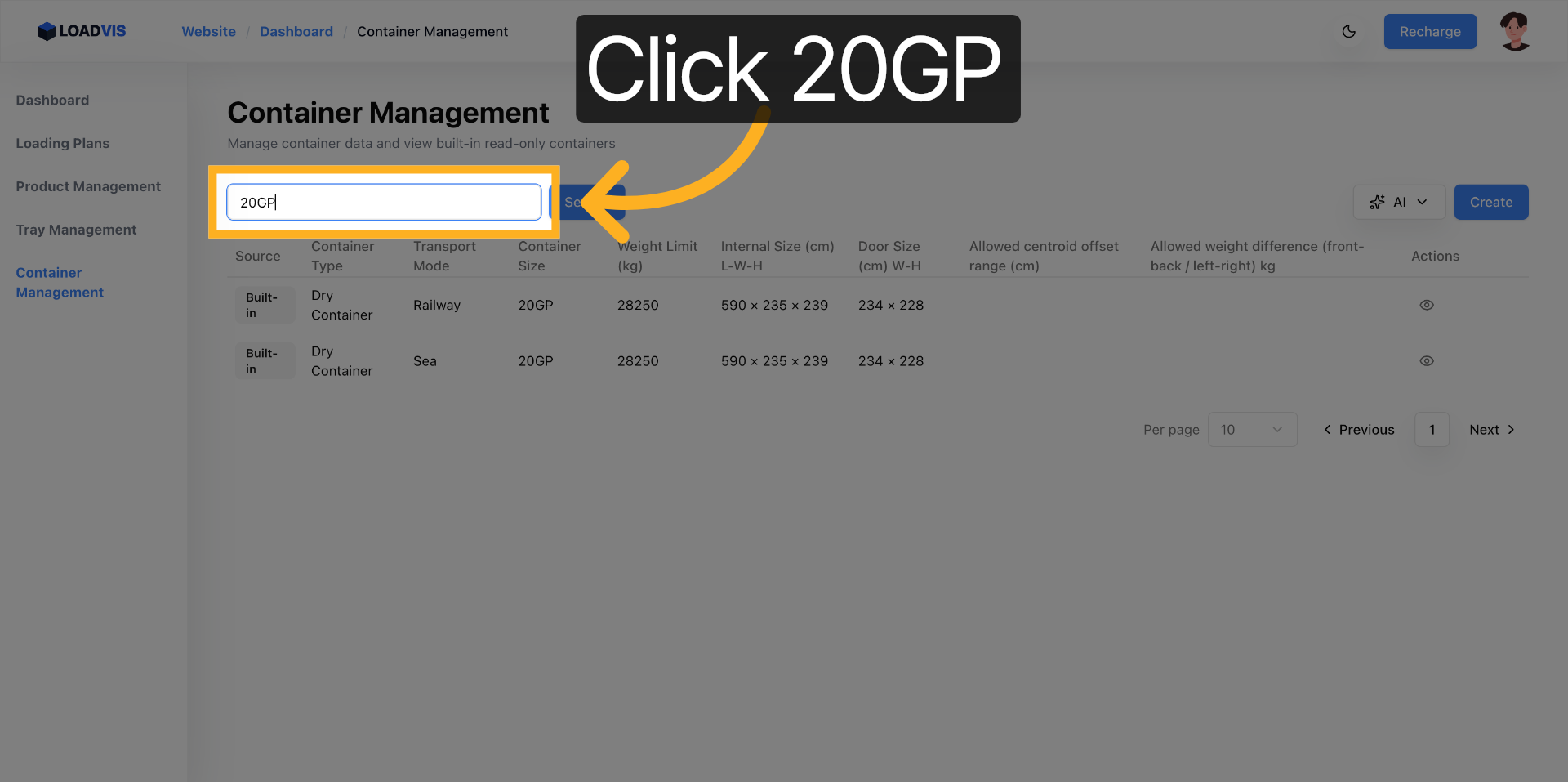

On ouvre le registre.

On ouvre le registre.

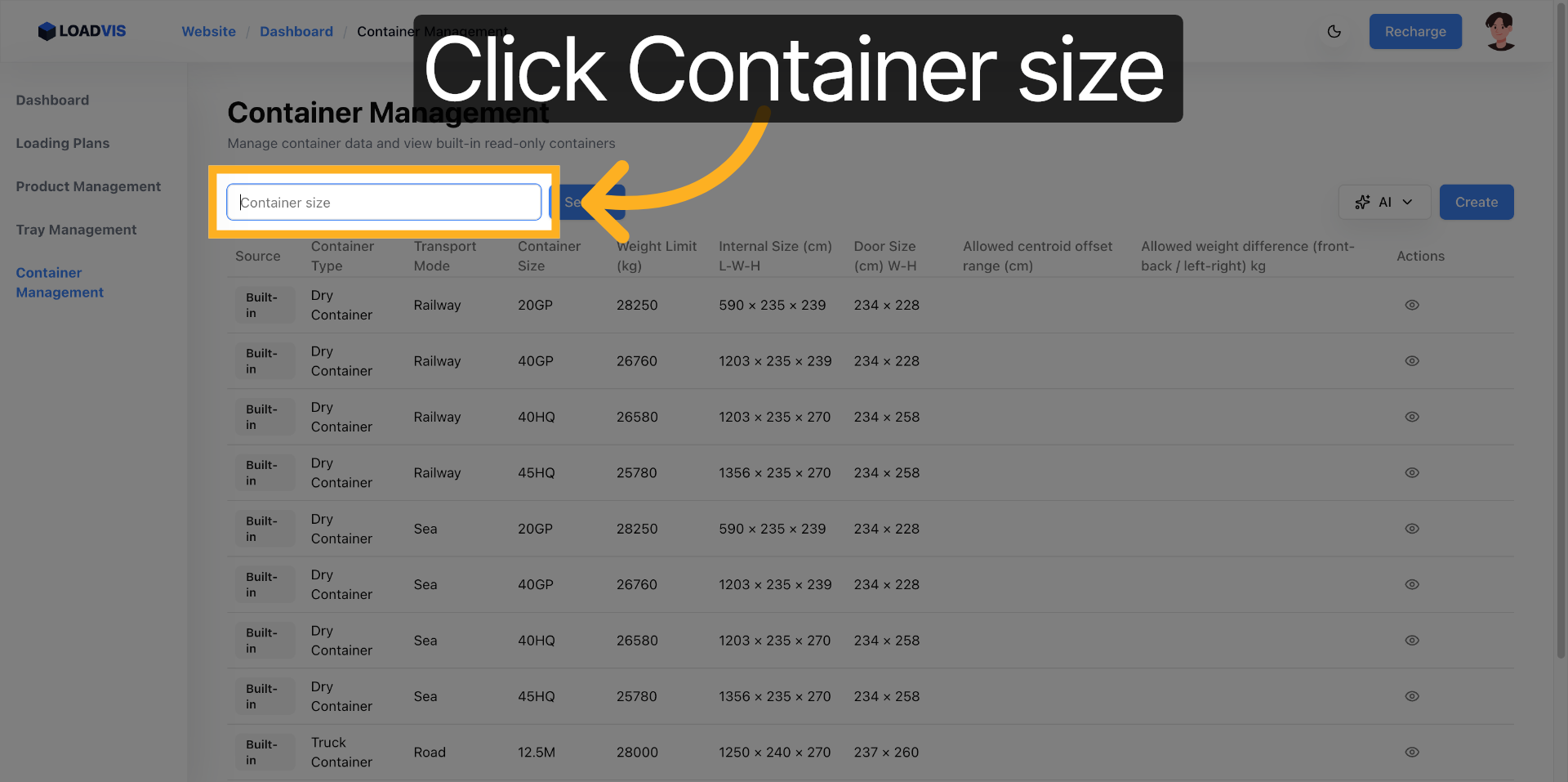

On déplie les conditions.

On déplie les conditions.

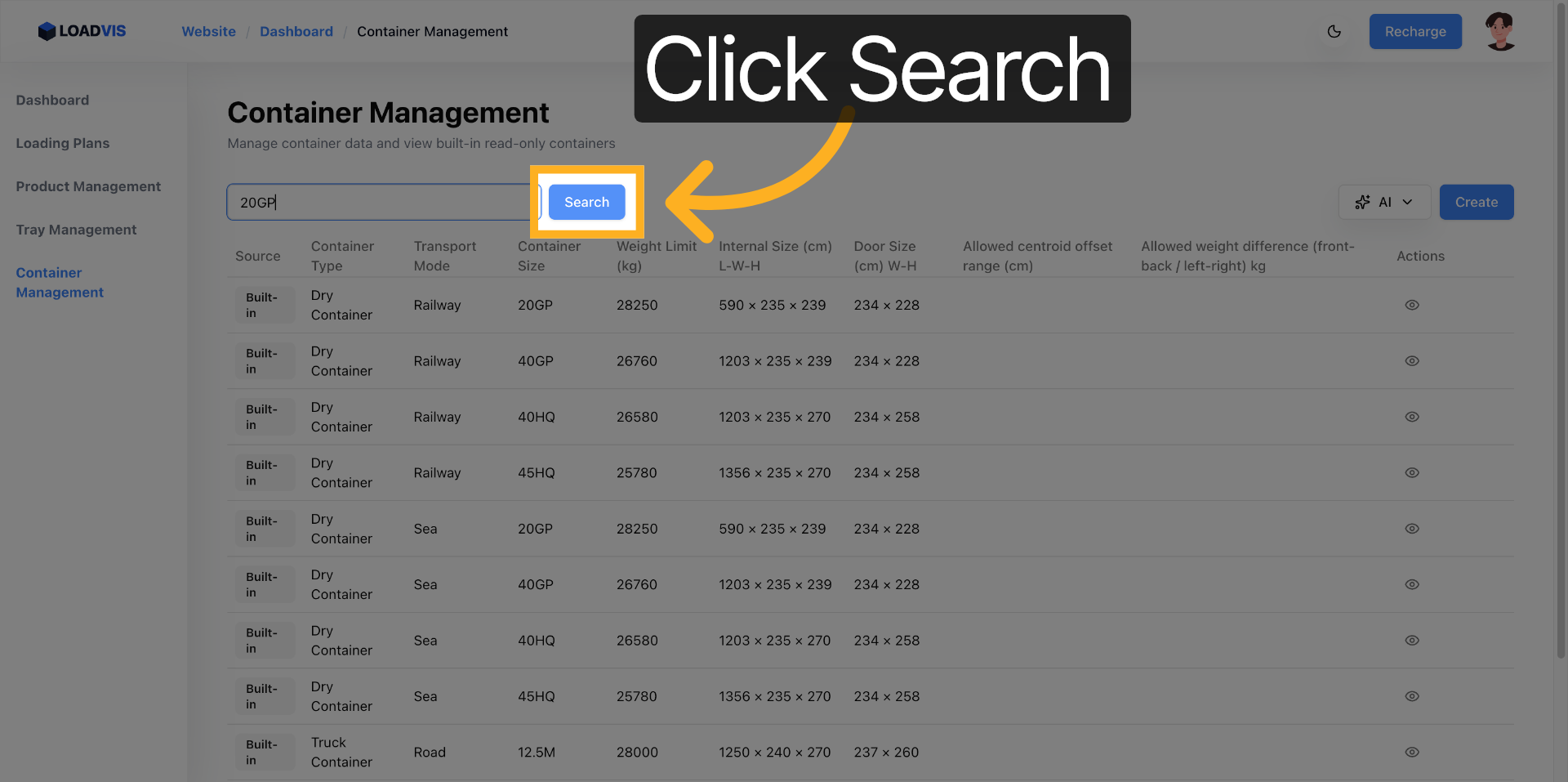

On injecte

On injecte 20GP.

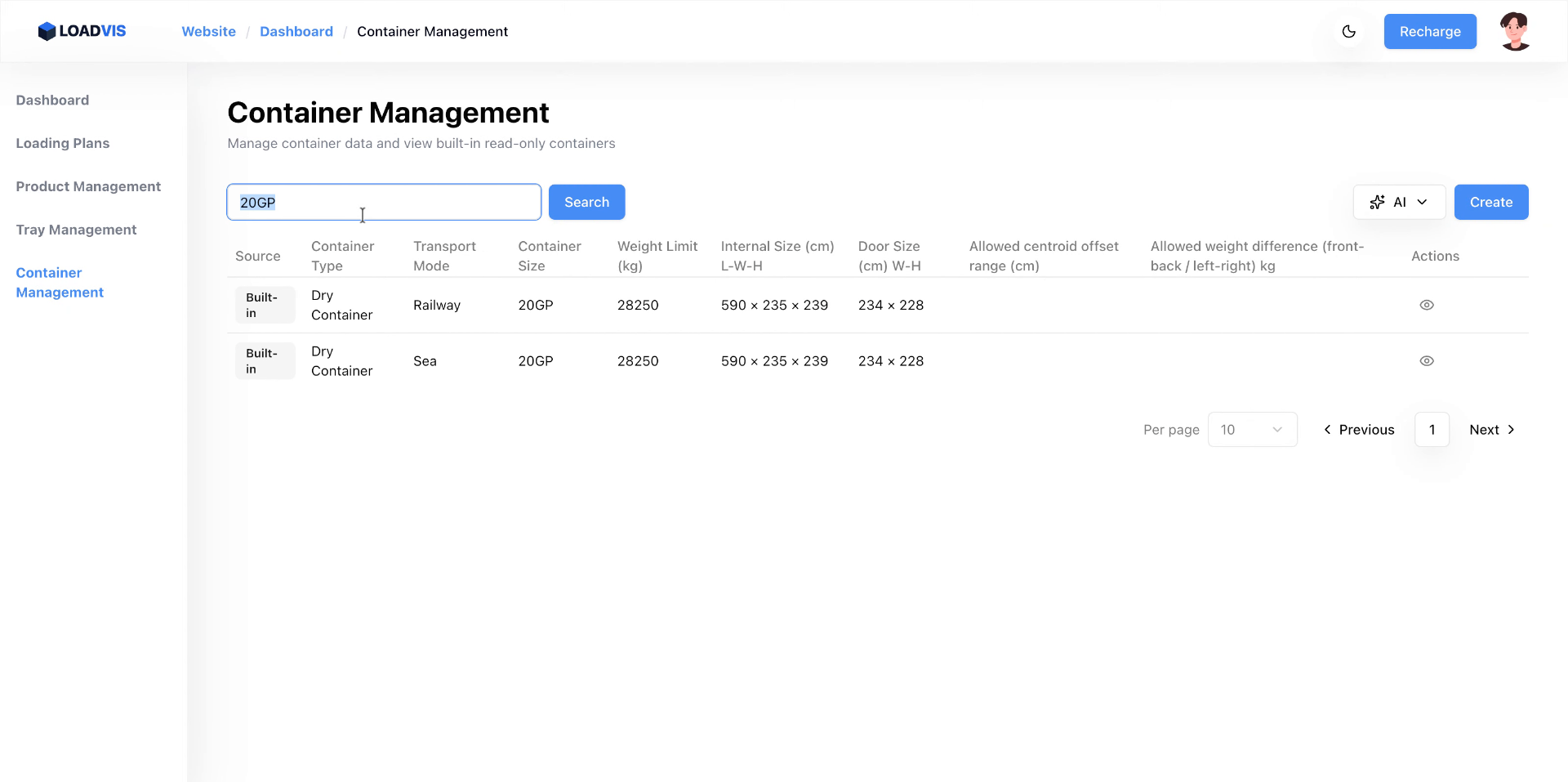

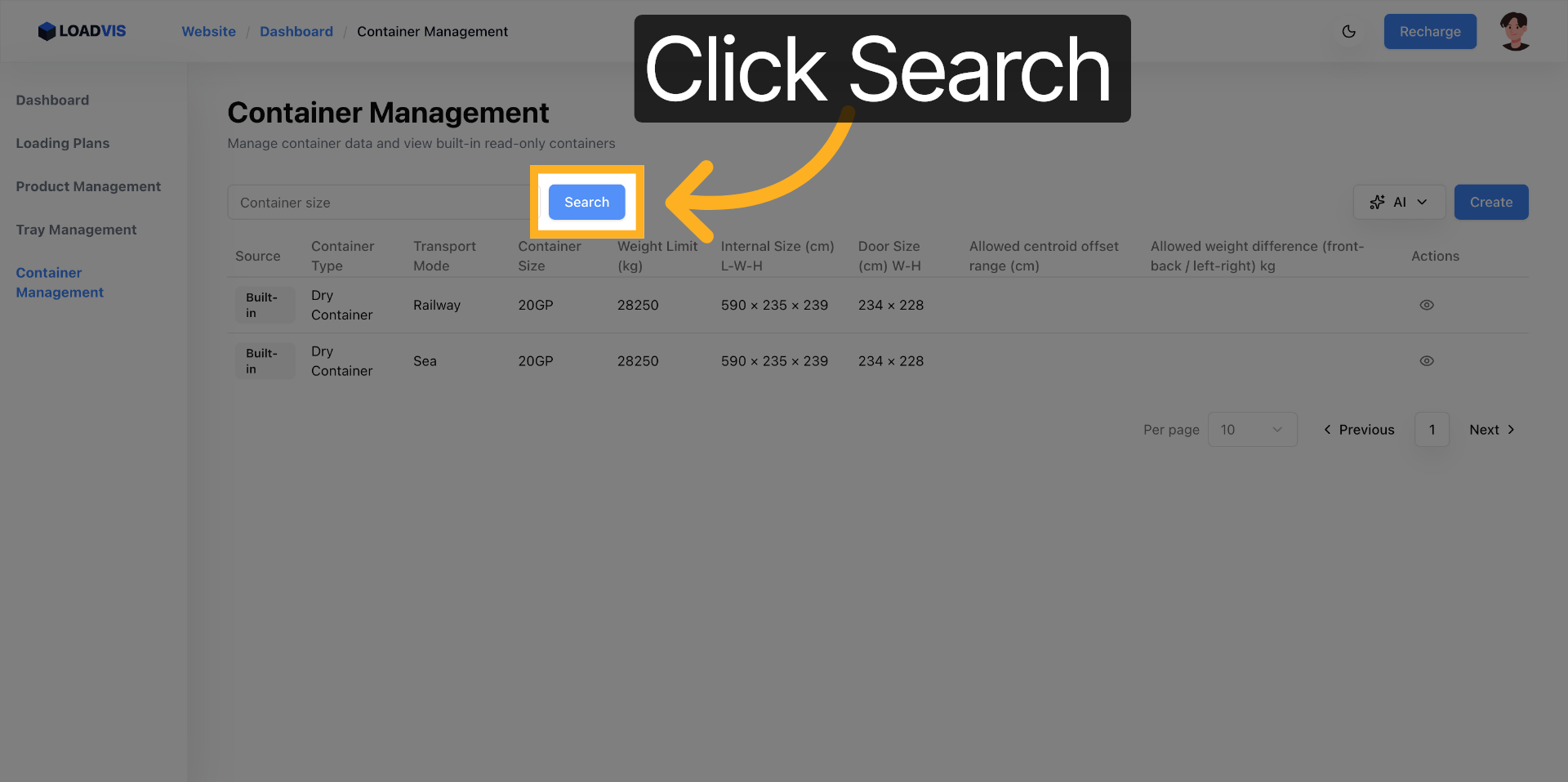

On lance la requête.

On lance la requête.

On cible l’entrée.

On cible l’entrée.

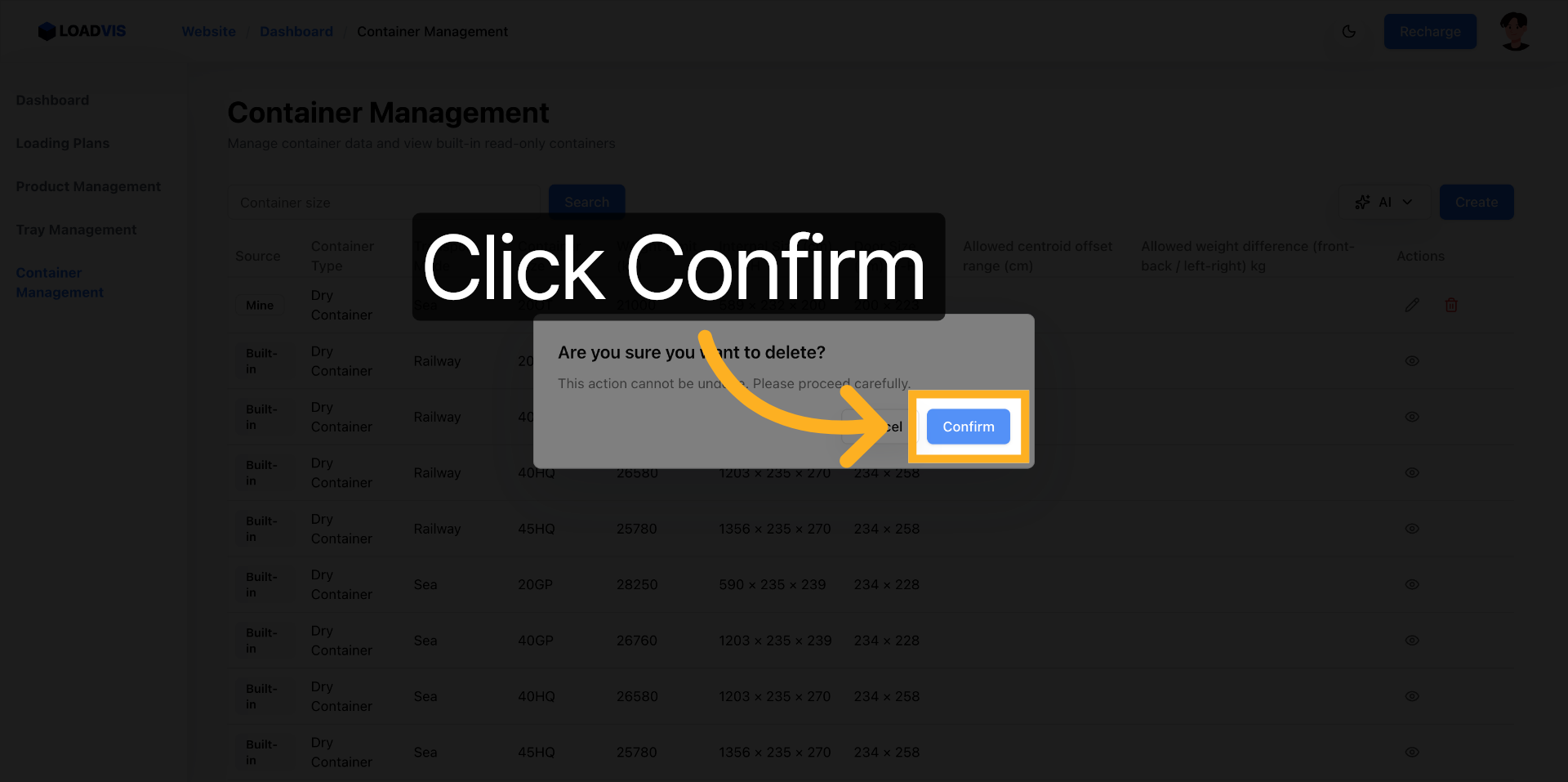

On confirme.

On confirme.

On affine le spectre si besoin.

On affine le spectre si besoin.

On réexécute.

On réexécute.

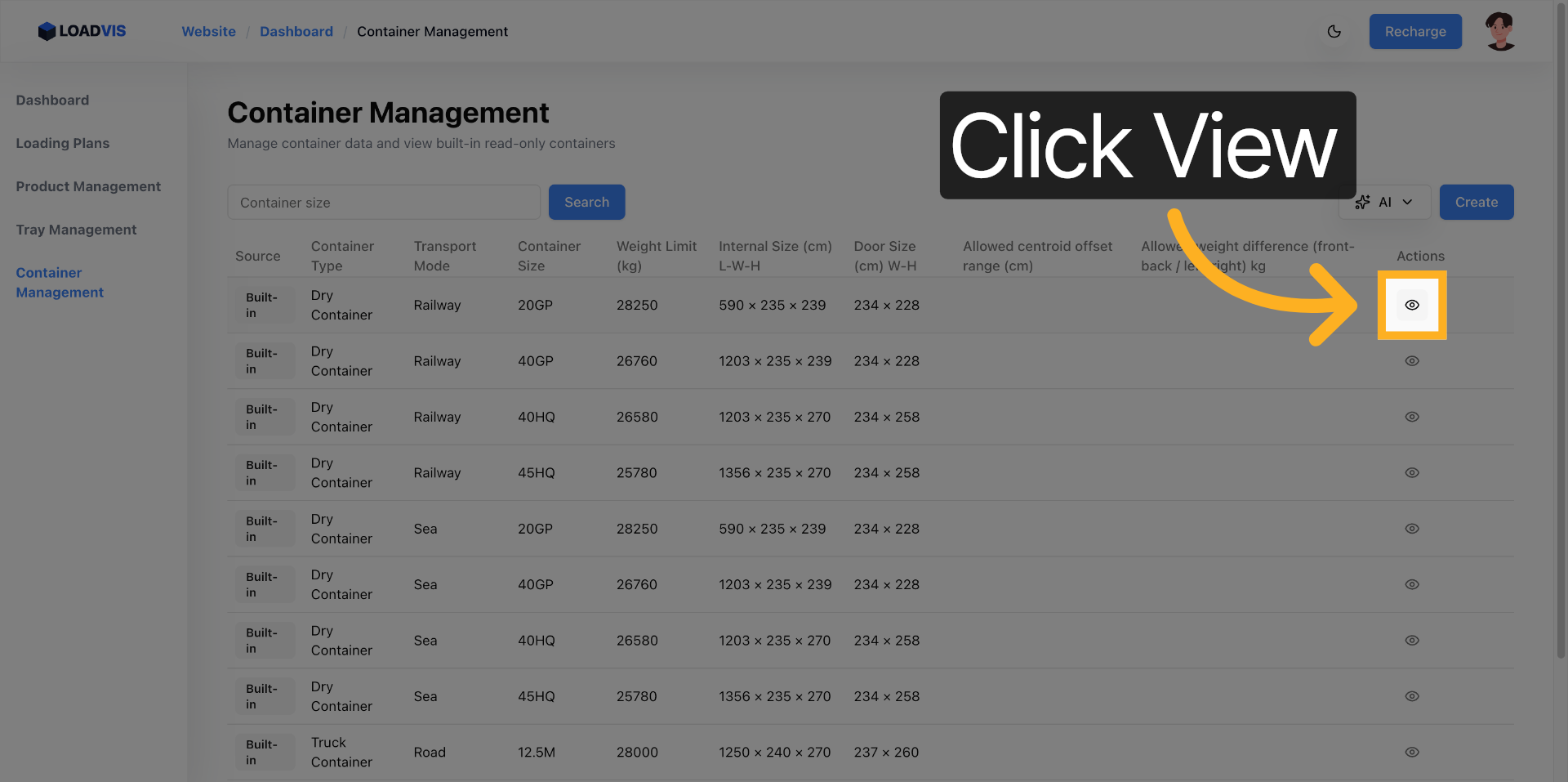

On inspecte les spécifications détaillées.

On inspecte les spécifications détaillées.

On referme le panneau. On repart.

On referme le panneau. On repart.

La suppression demande une double confirmation. Pas d’accident. Pas de rollback en production sans audit. On clique. On valide. L’enregistrement disparaît. La base respire.

La suppression demande une double confirmation. Pas d’accident. Pas de rollback en production sans audit. On clique. On valide. L’enregistrement disparaît. La base respire.

Tolérances réelles & angles morts

Attention aux faux positifs. Le solveur ne devine pas l’état d’usure des palettes. Il ne compense pas un plancher gondolé de 5 mm. Il applique strictement les bornes injectées. Si on lui demande d’optimiser un cube parfait, il livrera un cube parfait. Et le plan foirera au premier coin de rue.

La faisabilité terrain repose sur un périmètre de données sain. Des cotes réelles. Des limites de charge assumées. Des vérifications manuelles avant exécution. On structure l’environnement de calcul. Le moteur fait le reste. Ou il échoue. Mais au moins, on sait pourquoi.