Szenario-Rückblick: Wenn theoretische Ladevolumina in der Praxis scheitern

Rechnet man Beladepläne rein arithmetisch, sieht alles aus wie am Schnürchen. Die Volumenauslastung liegt bei 94 %. Kanten passen. Der Solver gibt grünes Licht. Dann steht der Stapler vor der Ladung. Fährt rein. Kippt. Warum? Weil Kubikmeter kein Ersatz für Physik sind. Volumetrische Optimierer arbeiten oft mit simplen AABB-Boxen. Sie ignorieren Schwerpunkte. Sie kennen keine Gabelkinematik. Sie berechnen Packdichte, keine Stabilität. Das klingt banal. Ist es nicht. In der Lagerrealität scheitern genau diese Annahmen regelmäßig. Nicht an der Rechenleistung. An fehlenden Parametern.

Ich habe Dutzende Implementierungen gesehen, bei denen die API glatt durchläuft, aber der Hallenboden nachgibt. Der Grund liegt fast immer in der Gewichtsverteilung. Ein Algorithmus verteilt Fracht, bis kein Hohlraum mehr übrig ist, und wenn er ohne harte Constraints für Maximalgewicht, Höhendifferenzen oder den Verstärkungsfreiabstand arbeitet, generiert er theoretisch machbare, praktisch aber instabile Lastbilder. Man verlässt sich auf Software, die keine Ahnung von der lokalen Tragfähigkeit hat. Oder von der tatsächlichen Palettengüte. Pappe sackt durch. Kunststoff deformiert sich unter Punktlast. Holz splittert. Die Mathematik bleibt sauber. Die Realität nicht.

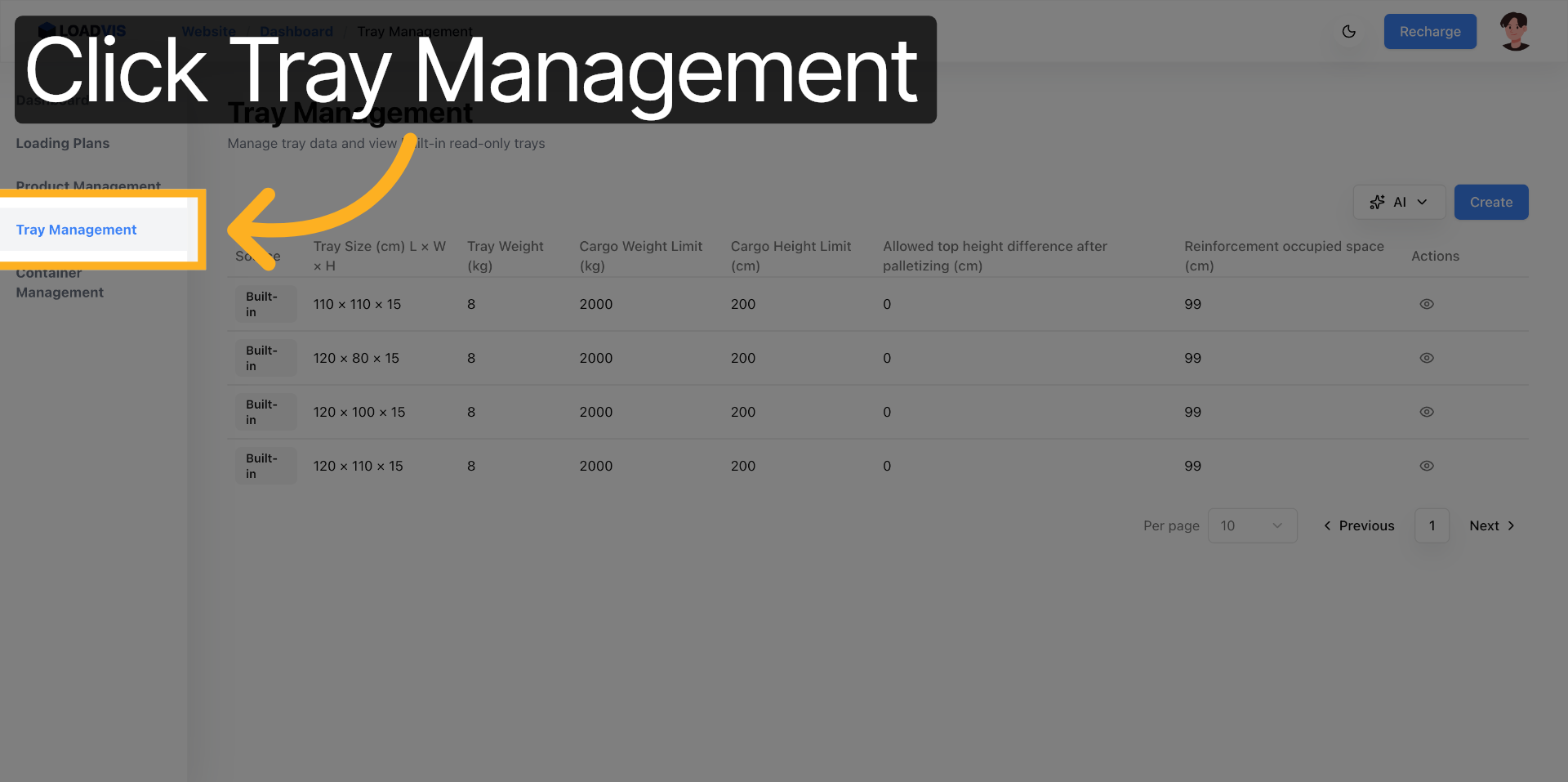

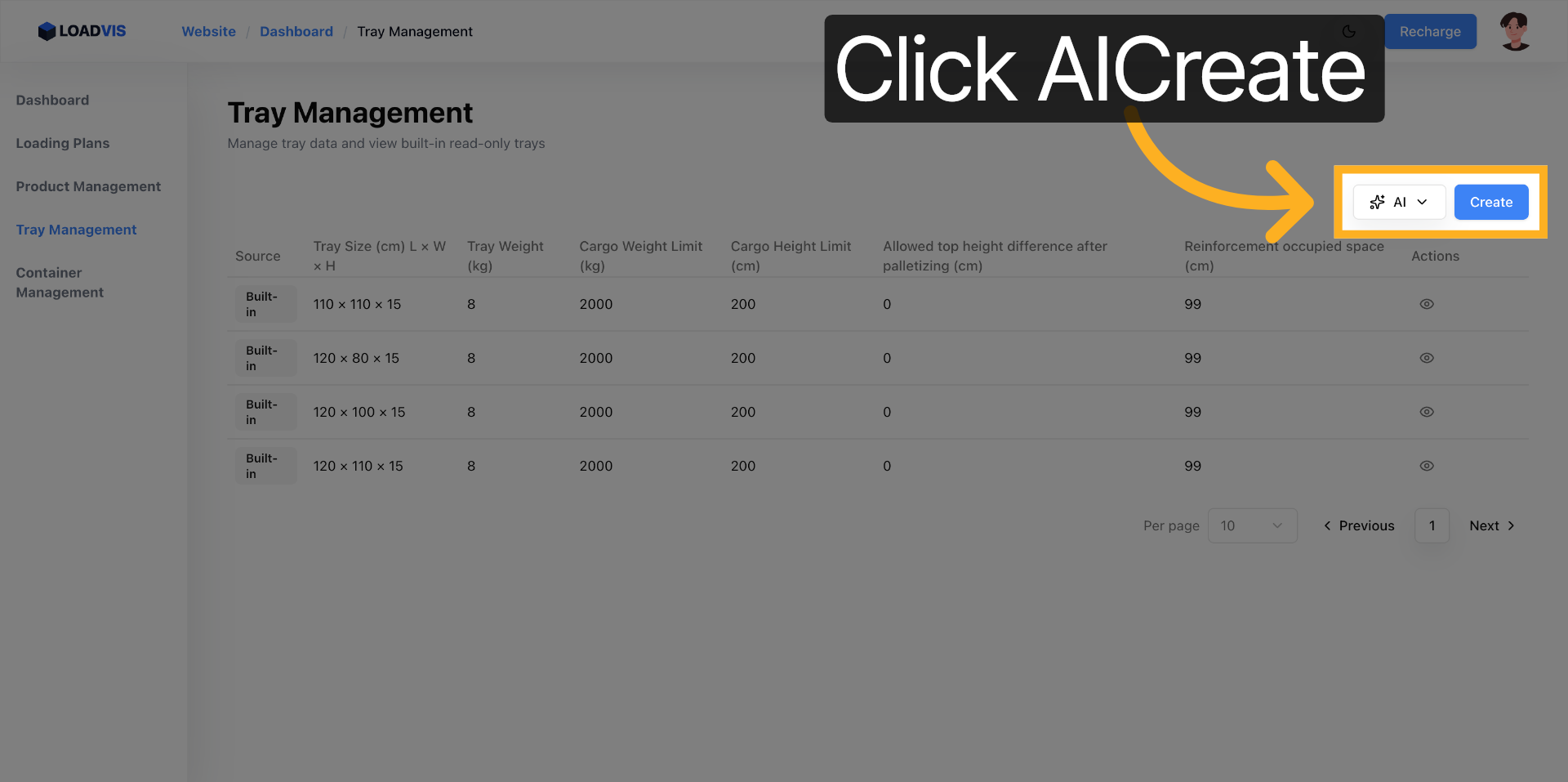

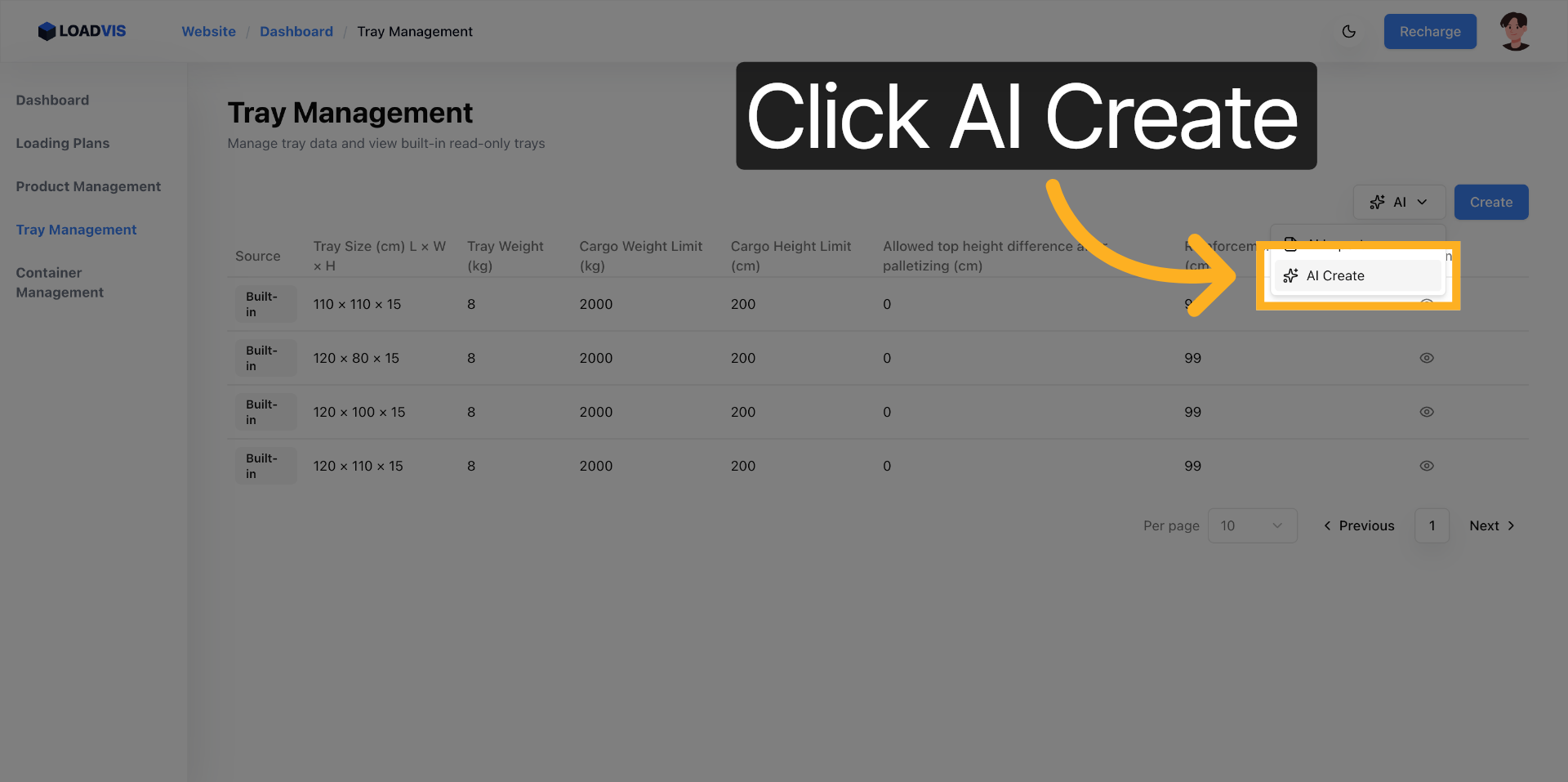

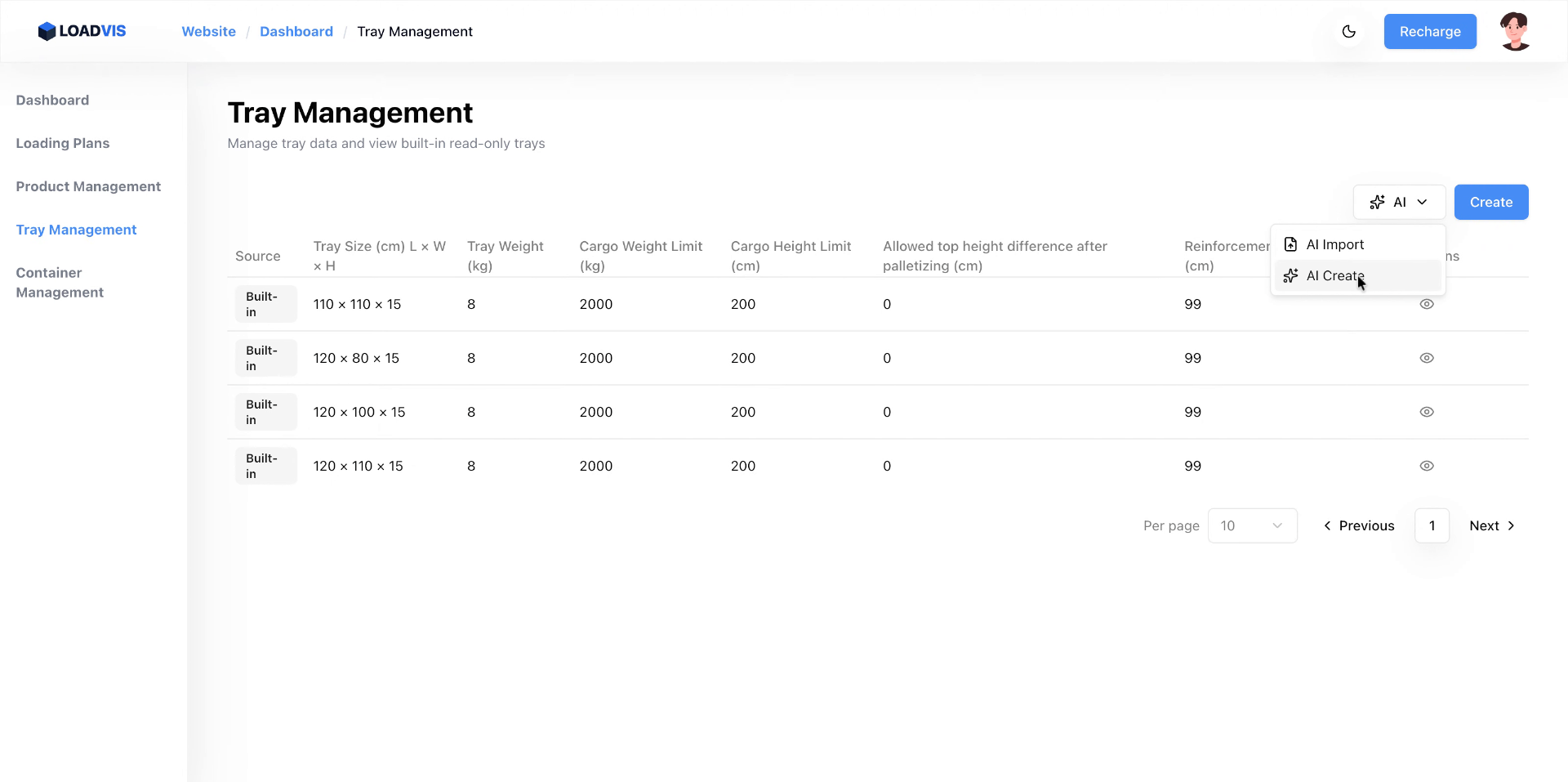

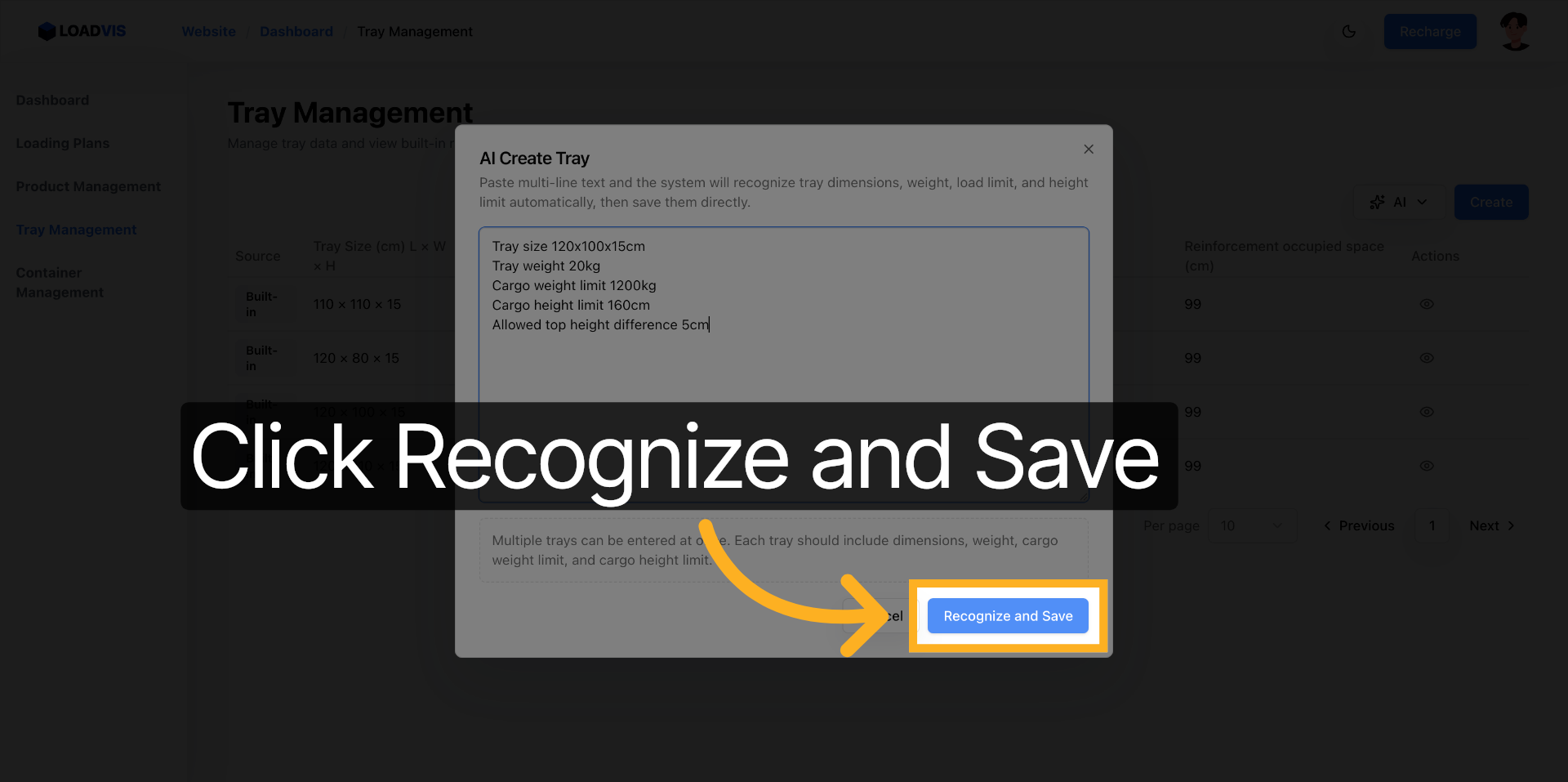

Hier setzt die parametrische Disziplin an. Bevor überhaupt ein Beladealgorithmus anläuft, müssen die Palettenspezifikationen als unverrückbare Hürden definiert werden. Keine weichen Toleranzen. Harte Grenzwerte. In Workspaces lässt sich das nicht mehr per Excel-Sheet und Bauchgefühl steuern. Man nutzt strukturierte Texteingaben oder manuelle Formulare. Die Extraktionslogik liest Rohtexte ein, parst Abmessungen, Eigengewicht, zulässige Frachtlast und Höhenvorgaben. Ordnet sie automatisch den Feldern zu. Speichert sie konsistent ab. Das verhindert rechnerische Überlastungen im Vorfeld.

Der Prozess ist technisch trivial. Operativ kritisch. Man öffnet das Verwaltungsmodul, aktiviert die intelligente Erstellung, wirft den Spezifikationstext in die Engine. Das System erkennt Muster. 120×100×15 cm. 20 kg Eigengewicht. 1.200 kg Maximalgewicht. Alles wird gemappt. Ein Klick auf die Freigabe finalisiert den Datensatz. Die Datenbank ist sauber. Die Constraints sitzen.

Funktioniert das reibungslos? Meistens ja. Bis der Boden uneben ist. Oder die Gabelstaplerlastkurve bei voller Hubhöhe abrupt einbricht. Hier kommt der operative Faktor ins Spiel. Manuelle Prüfungen, die nötig sind. Keine Software kann lokal wechselnde Bodenbeschaffenheiten, Produktverpackungstoleranzen oder die tatsächliche Gabelneigung im Blindflug vorhersagen. Die finale Freigabe bleibt eine Entscheidung des Verplaners. Er muss die generierten Constraints gegen die Infrastruktur spiegeln. Stimmen die Hublastkurven mit der erfassten Palette überein? Passt die Stapelreihenfolge zur Regalstatik? Falls nein: Korrigieren. Immer.

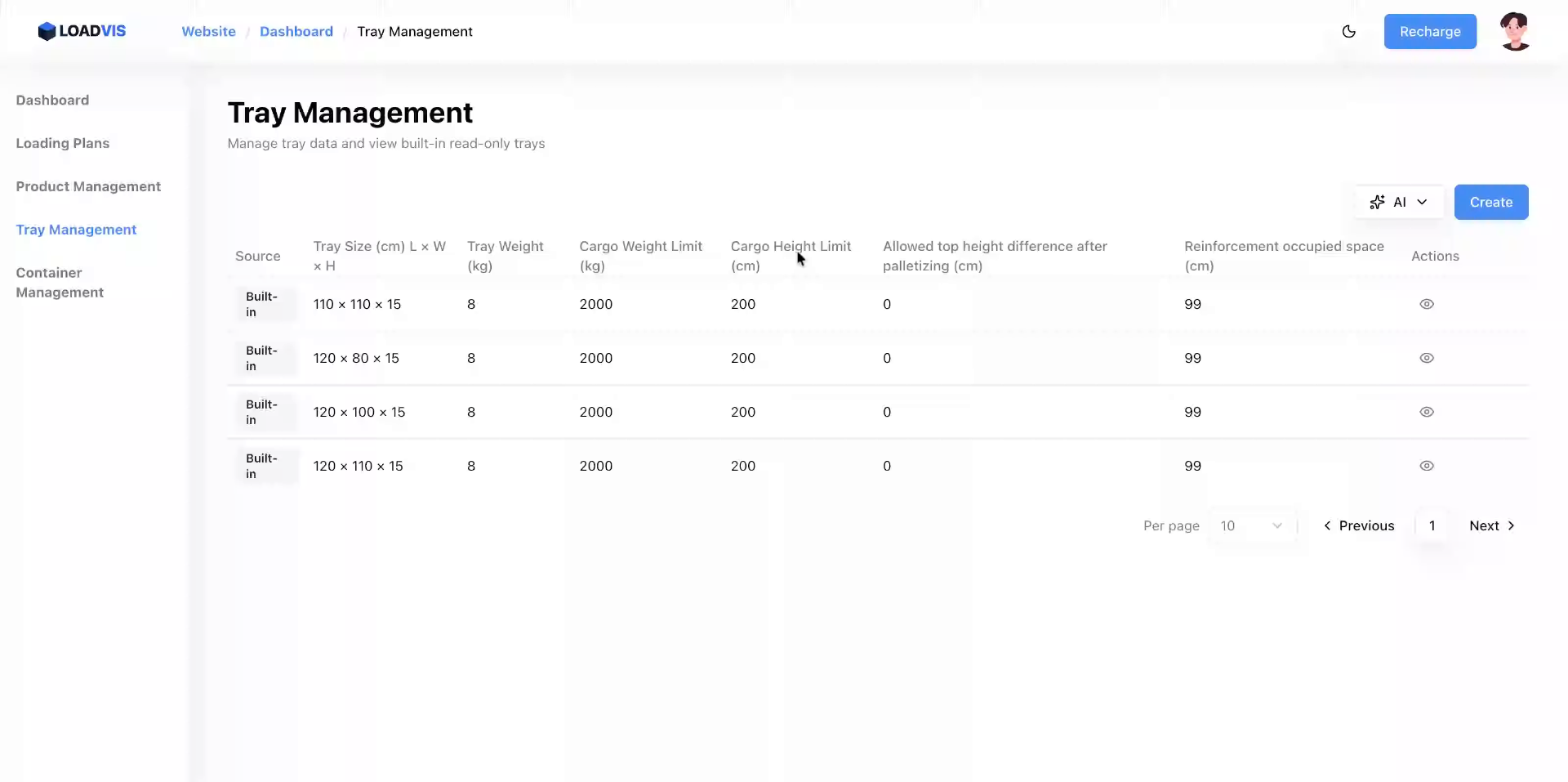

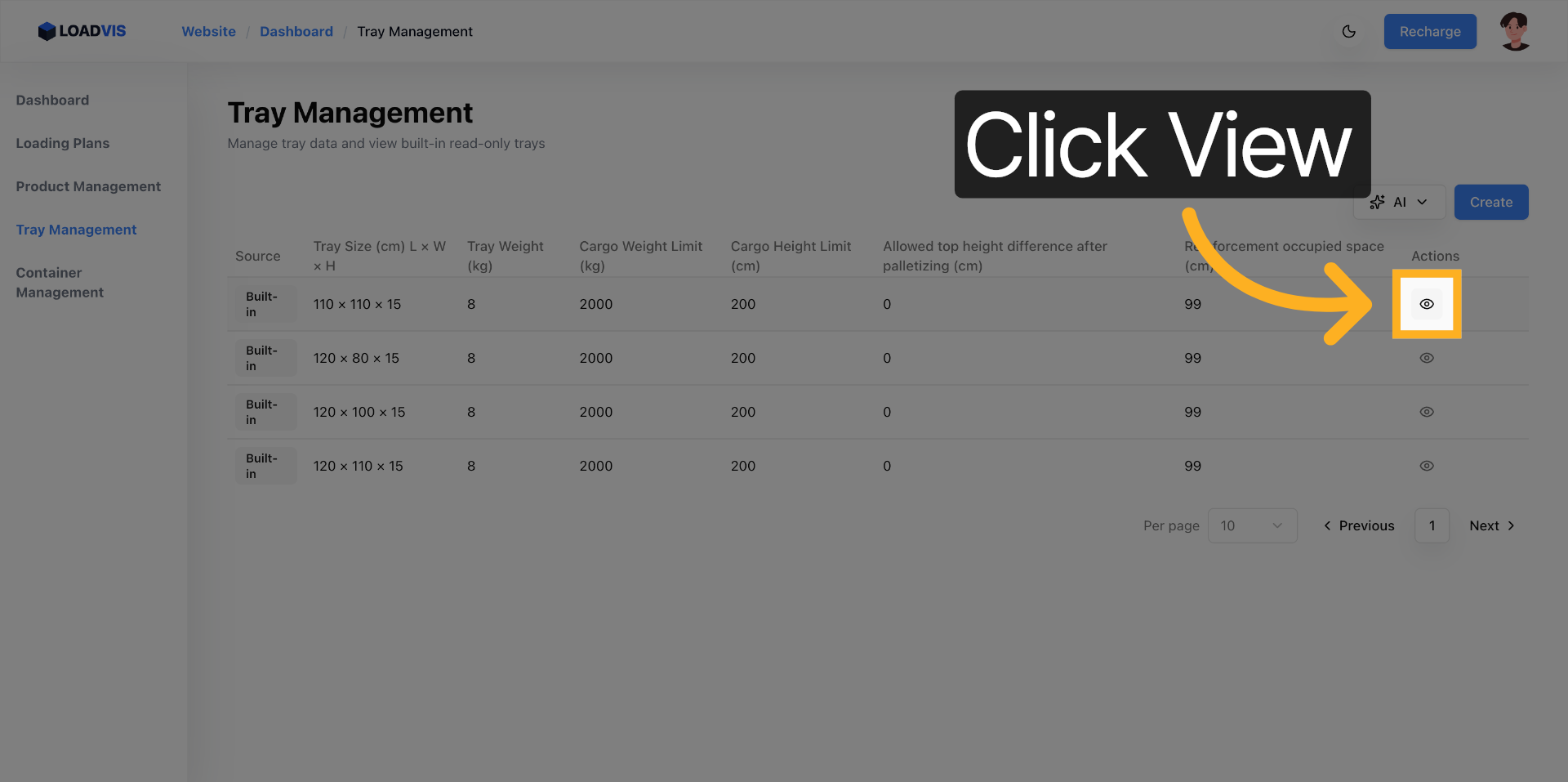

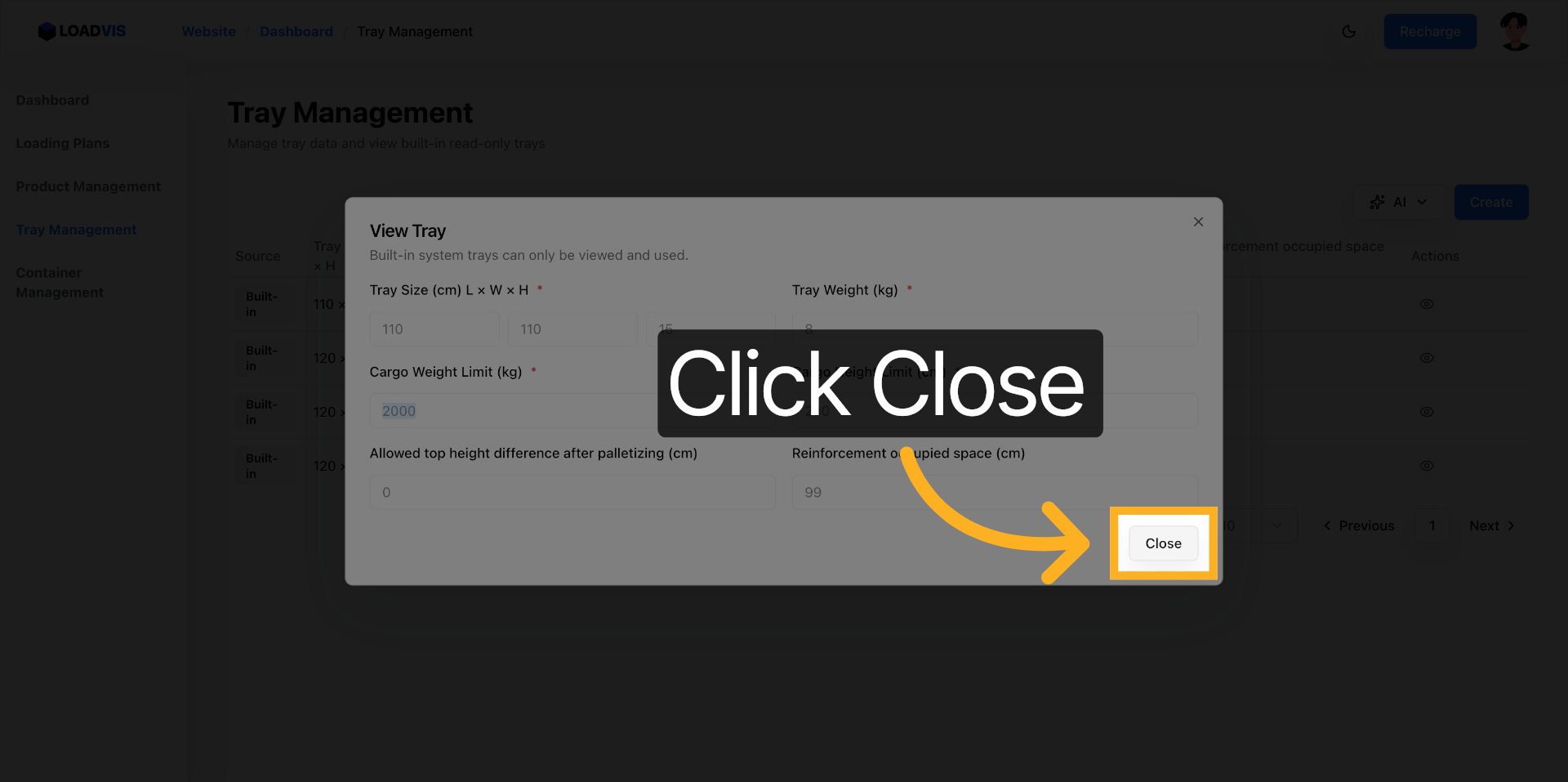

Die Pflege dieser Datensätze ist kein One-off. Lager rotieren Paletten. Spezifikationen ändern sich durch Lieferantenwechsel oder Materialupgrades. Ein Datensatz muss gelegentlich angepasst oder entsorgt werden. Das System bietet direkte Ansichten der hinterlegten Metriken. Man prüft die Dimensionen, schließt die Detailansicht, navigiert weiter. Bei Anpassungen überschreibt man die Werte bewusst. Bei veralteten Einträgen nutzt man den Löschmechanismus mit doppelter Bestätigung. Verhindert Datenmüll. Hält die Constraint-Liste valide.

Grenzen existieren. Immer. Selbst perfekt parametrisierte Datenbanken decken keine dynamischen Umweltfaktoren ab. Feuchtigkeitsgehalt im Holz ändert die Steifigkeit um bis zu 15 %. Kartonagen quellen auf. Die Toleranzwerte aus dem ERP-System liegen oft 3-5 mm unter der physischen Realität. Algorithmen rechnen mit exakten Float-Werten. Lagerarbeiter arbeiten mit Millimetern Spielraum und Erfahrung. Manuelle Prüfungen, die nötig sind, kompensieren diese Lücke. Sie sind keine Schwachstelle. Sie sind der Sicherheitsanker. Ohne sie rutschen Gewichtsvektoren ins Unwägliche. Containerbeladung wird zum Ratespiel. Operative Risikoanalyse verpufft im Backend.

Technische Tools beschleunigen die Planung. Sie ersetzen aber keine physikalische Validierung. Volumetrische Füllgrade sind nur eine Kennzahl. Stabilität ist eine andere. Wer beides trennt, zahlt mit beschädigter Ware oder stillstehenden Rampen. Parametrisierung ist die Basis. Menschliche Verifikation ist das Sicherheitsnetz. Beides zusammengenommen liefert belastbare Ergebnisse. Nicht perfekte. Aber reale.