Retrospektive: Wenn die Volumenquote täuscht

Disponenten starren oft auf 94 Prozent. Ein stolzer Wert. Auf dem Papier. Der LKW steht bereits. Dann kippt die Ladung schon beim ersten Bremsmanöver. Warum? Weil Volumenoptimierung und Transportphysik in den meisten Planungssystemen noch immer zwei verschiedene Welten sind. Ein Algorithmus packt geometrisch perfekt. Er ignoriert aber regelmäßig, wie sich Massen verhalten, wenn sie in Bewegung geraten.

Wir validieren oft nur Kennzahlen. Grün bedeutet Freigabe. Rot bedeutet Nacharbeit. Dazwischen existiert eine massive Blindzone. Die reale Verladung scheitert selten an fehlender Kapazität. Sie scheitert an dynamischen Schwerpunktlagen. An Paletten, die unter ungleicher Last ausbeulen. An Türen, die zu eng sind, weil der Solver die Anfahrwinkel des Staplers mathematisch nicht berücksichtigt hat. Manuelle Prüfungen, die nötig sind, werden systematisch auf den letzten Drücker verschoben. Das geht nur so lange gut, bis der erste Transportschaden auf dem Tisch liegt.

Warum die Physik im Code untergeht

Disposition lebt von Quoten. Prozentuale Auslastung ist einfach zu tracken. Gewichtsverteilung ist schwer zu normieren. Wenn ein Beladungsalgorithmus auf Basis reiner Volumenkombinatorik arbeitet, priorisiert er automatisch Lückenfüllung über statische Stabilität, weil die mathematische Optimierung den maximalen Packfaktor sucht, ohne dass die physikalische Traglastmatrix der untersten Palettenebene in die Konvergenzgleichung einfließt.

Stapelrestriktionen werden in Standardkonfigurationen oft deaktiviert. Warum? Um die Zielquote schneller zu erreichen. Kurzfristige Effizienz. Langfristige Risiken.

Der sichere Ansatz funktioniert anders. Er zwingt den Solver, Constraints zu respektieren. Tragfähigkeitsstufen werden explizit definiert. Gewichtsbalancierung wird erzwungen. Der Algorithmus wechselt von reiner Geometrie zu Logistiklogik. Das kostet Rechenzeit. Es reduziert die theoretische Auslastung manchmal um 3 bis 5 Prozent. Dafür stehen die Schwerpunktabweichungen innerhalb tolerierbarer Grenzen. Die Zugänglichkeit ist garantiert. Entladereihenfolgen kollidieren nicht mit lokalen Hebezeugkapazitäten. Planer müssen hier iterativ vorgehen. Keine Ein-Klick-Lösung. Ständiger Abgleich. Manuelle Prüfungen, die nötig sind, bleiben die einzige Barriere gegen Daten-Arroganz.

Dateninput ist keine Formsache

Stammdaten bestimmen das Ergebnis. Garbage in, garbage out. Das ist keine Floskel. Es ist harte Realität. Wenn die Systemumgebung intelligente Texterkennung anbietet, klingt das verlockend. Spezifikationstexte werden geparst. Abmessungen extrahiert. Gewichte zugeordnet. Aber Parsing-Logik hat Grenzen. Synonyme variieren. Maßeinheiten springen. Ein KI-Modul erkennt nicht automatisch, ob „2000x1000" Millimeter oder Zoll meint, wenn die Metadaten fehlen. Es ordnet Werte zu. Es validiert keine Plausibilität.

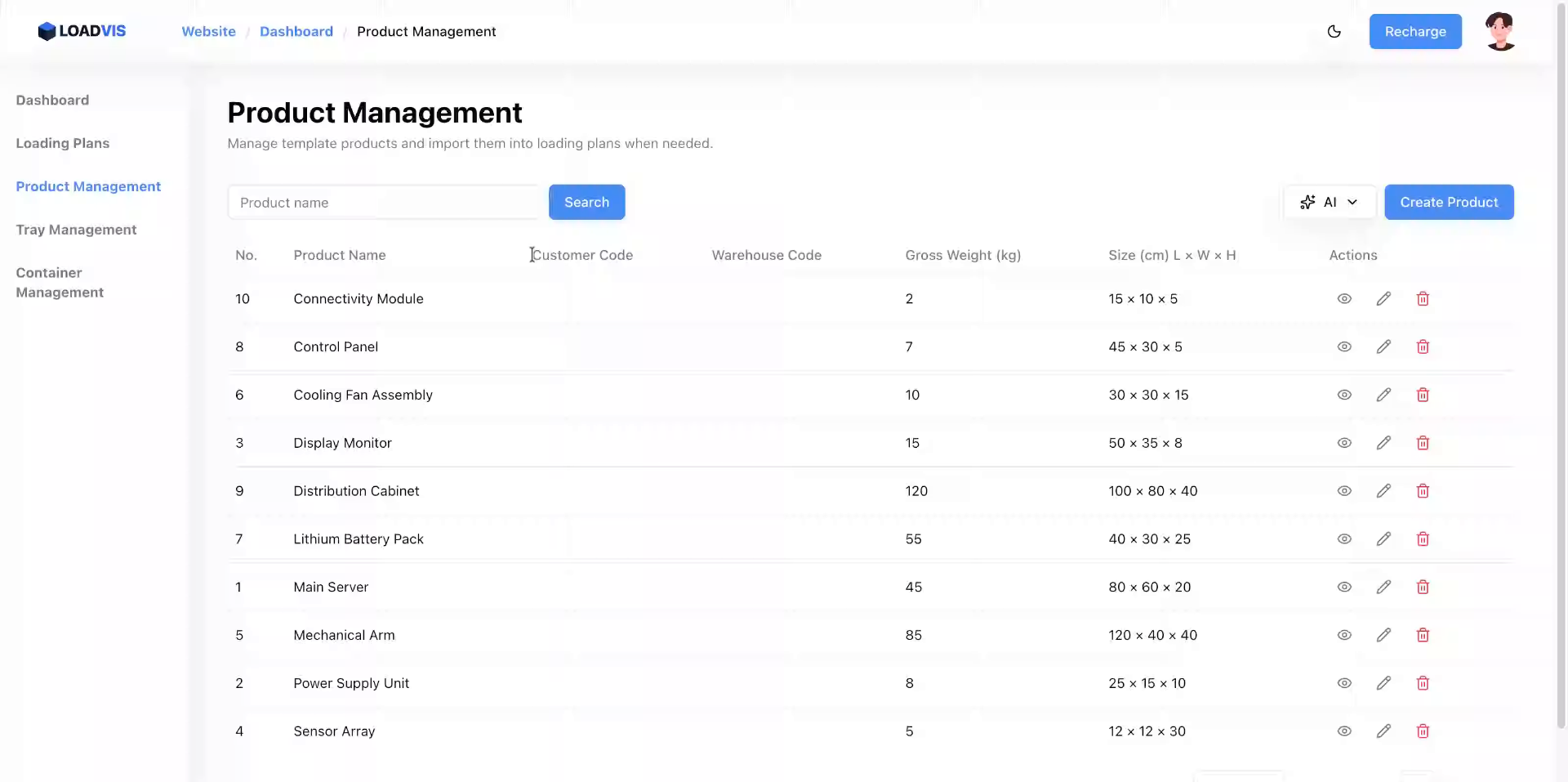

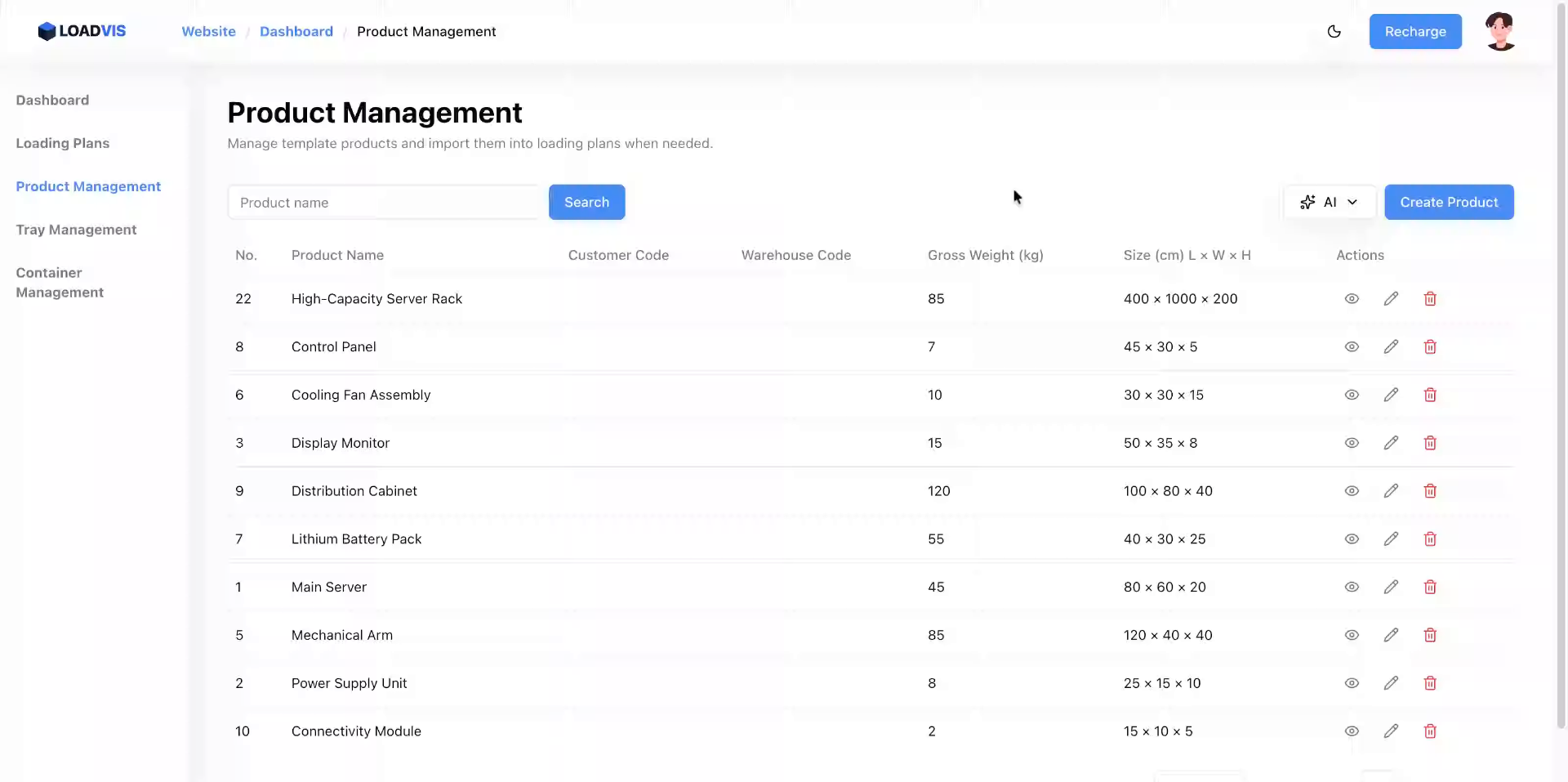

Hinweis zur Datenstruktur

Hinweis zur Datenstruktur

Manuelle Parametrisierung ist mühsam. Aber kontrollierbar. Seriennummern, Bruttogewichte, exakte L×B×H-Abmessungen müssen geprüft werden. Ein Klick auf „Erkennen und erstellen" beschleunigt die Erfassung. Er erspart keine fachliche Validierung. Wenn die Bodenbeschaffenheit am Verladeort schlecht ist, helfen auch noch so schön geparste Metadaten nicht weiter. Die Software generiert 3D-Leitpläne. Sie warnt bei Grenzwertüberschreitungen. Sie liefert datenbasierte Entscheidungshilfen. Sie ersetzt keine operative Erfahrung. Disponenten müssen die generierten Ansichten gegen reale Palettenqualität abgleichen. Manuelle Prüfungen, die nötig sind, finden genau an dieser Schnittstelle statt. Nicht später.

Grenzen der Automatisierung akzeptieren

Wir erwarten oft zu viel von Constraint-Solvern. Sie optimieren innerhalb definierter Boxen. Sie kennen die reale Welt nur durch die Parameter, die wir füttern. Länderspezifische Transportvorschriften liegen außerhalb des Algorithmus. Kundenseitige Entladeprotokolle werden nicht automatisch erkannt. Die Bodenbelagstoleranz einer Speditionshalle ist im System nicht hinterlegt. Der Algorithmus rechnet mathematisch sauber. Er operiert in einem Vakuum.

Stammdaten justieren

Stammdaten justieren

Falsche Konfiguration führt zu Blockaden. Deaktivierte Stapelrestriktionen maximieren Quoten. Sie produzieren aber instabile Türme. Reine Mengeneingaben ohne Gewichtskorrektur lassen den Solver blind agieren. Validierung nur des Gesamtergebnisses überlebt selten den ersten Rampentest. Der operative Mehrwert entsteht nicht durch Bedienungsgeschwindigkeit. Er entsteht durch Konfigurationsdisziplin. Durch das bewusste Setzen von Limits. Durch den Mut, theoretische Auslastung zugunsten operativer Machbarkeit zu opfern. Wenn Dinge schiefgehen, liegt die Ursache fast immer in fehlenden Constraints, nicht in der Rechenpower des Systems.

Manuelle Prüfungen, die nötig sind, lassen sich nicht automatisieren. Sie erfordern Kontextwissen. Sie verlangen, dass Planer generierte Leitansichten kritisch hinterfragen. Sie zwingen dazu, lokale Hebezeug-Reichweiten manuell abzugleichen. Die finale Freigabe bleibt eine dispositive Verantwortung. Kein Algorithmus unterschreibt die Transportabnahme. Wir konfigurieren Werkzeuge. Wir ersetzen keine Fachkompetenz.

Das System liefert Platzierungsvorschläge. Wir validieren die Physik. Die Lücke bleibt bewusst bestehen. Nur so funktioniert Logistikplanung im Feld. Ohne Illusionen. Mit klaren Restriktionen. Und mit dem ständigen Eingeständnis, dass die Realität immer komplexer ist als das Datenmodell.